Disinformazione e manipolazione. Il pericolo è il microtargeting degli annunci politici

16 min letturaDurante la campagna per il referendum del 2016 sulla Brexit, Boris Johnson ha girato il Regno Unito con un autobus che recava uno slogan: “Inviamo all’UE 350 milioni di sterline a settimana. Piuttosto finanziamo il National Health Service”.

Si trattava di un’informazione inaccurata, se non falsa, ma questa fake news grossa come un autobus ha girato l’intero paese. Le televisioni hanno intervistato Johnson più volte, e ovviamente lui si faceva riprendere dinanzi all’autobus. I giornali ne hanno parlato spesso, fotografando Johnson dinanzi all'autobus. Così la “notizia” è rimbalzata costantemente nelle case di tutti i cittadini tramite i media mainstream. E poi è stata condivisa anche nei social network.

Non era un annuncio politico, non stava su Facebook ma, grazie ai media mainstream (giornali e Tv) ha avuto una diffusione capillare e, probabilmente, anche un effetto piuttosto rilevante. Eppure, il dibattito sulla disinformazione (termine più corretto rispetto a "fake news") generalmente si avvita sempre intorno a Internet e ai social media.

Leggi anche >> La disinformazione è una bestia dai mille volti: impariamo a riconoscerla

La prima proposta di legge del neonato partito Italia Viva è, infatti, in tema di fake news. Lo scopo è di indagare “sui ‘casi di diffusione seriale e massiva’ delle fake news” anche nei cinque anni precedenti alla data di entrata in vigore della legge. In sostanza, si tratta di andare a vedere se Matteo Renzi ha perso il referendum del 2016 per colpa delle fake news.

Italia Viva chiede al Parlamento di “dotare al più presto l’ordinamento di una specifica disciplina per contrastare” la disinformazione e di “responsabilizzare i social network” al fine di “tutelare gli utenti da notizie costruite intenzionalmente per trarli in inganno”. “L’importanza sempre maggiore dei social network per la formazione dell'opinione pubblica nelle società democratiche ha, negli ultimi anni, generato il fenomeno delle cosiddette fake news, ossia delle notizie false che suscitano allarme sociale, spesso immesse nel circuito delle reti sociali telematiche (social network) per condizionare l'opinione pubblica di un Paese”, si legge nel testo di accompagnamento della proposta.

Insomma, l’intenzione è quella di creare una Commissione pagata dai cittadini, che si occupi di stabilire cosa è fake news e eventualmente di reprimerle. Chiaramente con riferimento solo all’ambiente digitale. Interessante, salvo che con questa proposta un autobus alla Johnson potrebbe scorrazzare tranquillamente per tutto il paese senza problemi. Però, in compenso, la Commissione potrebbe silenziare quelli che contestano sui social network lo slogan raffigurato sui lati. E in questo quadro la “responsabilizzazione” delle aziende del web appare sempre più un modo per strumentalizzarle quale longa manus della politica per rimuovere i contenuti sgraditi.

Leggi anche >> Perché diciamo no a una Commissione parlamentare d’inchiesta sulle “fake news”

Perché il punto alla fine è sempre quello. Basta notare come durante la manifestazioni della Lega la polizia si è adoperata con eccessiva solerzia per rimuovere tutto ciò che poteva “disturbare”, per capire che in Italia (ma non solo) c’è un concreto rischio che una regolamentazione del genere possa essere strumentalizzata per reprimere il dissenso politico. Abbiamo almeno un caso nel quale il sequestro degli striscioni contro l’ex ministro Salvini non è stato convalidato dalla magistratura perché si trattava di legittima critica politica.

La giustificazione delle autorità risiede in una legge del 1948 (art. 72) che sanziona la “turbativa della propaganda elettorale”. Insomma, il concetto in Italia è chiaro e fermo dal ‘48, la politica ha la precedenza su tutto, il politico ha il diritto di fare propaganda (anche utilizzando notizie false) e il cittadino non deve intromettersi. In un quadro del genere come pensate che finirebbe con una legge che vieta le fake news (solo online)?

La teoria della pallottola magica

Il dibattito e la sua focalizzazione sul “problema Internet” sono nati sostanzialmente con l’elezione di Trump e con la Brexit. In merito a questi eventi, largamente inaspettati, invece di fare un'onesta analisi sulle mancate previsioni degli “esperti”, si è alimentata una paradossale caccia alle streghe che ha sovrastimato sia le fonti che il fenomeno stesso, che l’impatto sull’opinione pubblica.

Siccome Trump ha vinto le elezioni, non poteva essere una sorta di cambiamento di rotta dell'opinione pubblica stanca di politiche sempre uguali a se stesse, sempre con le stesse facce e le stesse promesse mai mantenute, non poteva essere un fallimento dei governanti, un voto di protesta. No, doveva essere colpa delle fake news (ovviamente quelle digitali), doveva essere colpa dei cittadini stupidi che si fanno manipolare. E da qui la necessità, anzi l’obbligo per la classe politica, l'élite, di tutelare la libertà dei cittadini sopprimendola. In poche parole, leggi: leggi che impongono alle piattaforme del web di rimuovere contenuti a tutto spiano, leggi per creare commissioni che studino come eliminare le fake news. Peccato che fino ad oggi tutta questa dietrologia rimane largamente non provata, e il fenomeno in sé largamente sovrastimato.

Leggi anche >> I troll russi sono riusciti a “convincere” i media, ma non l’elettorato

La proposta di Italia Viva recita: “L’importanza sempre maggiore dei social network per la formazione dell'opinione pubblica nelle società democratiche ha, negli ultimi anni, generato il fenomeno delle cosiddette 'fake news'”. Ma è vero?

Le premesse nascono da epoche lontane, quando i media erano solo televisione e giornali. La base è la “teoria della pallottola magica” (magic bullet theory), da non confondere con quella dell’omicidio di John Kennedy ovviamente, la quale presume che (The Evolution of Media Effects Theory: A Six‐Stage Model of Cumulative Research):

- L’audience (il pubblico) di un mass media è costituita da una massa indifferenziata.

- Il media ha un impatto identico su tutta l’audience.

- L’impatto è lo stesso sia se si pubblicizza un detersivo per i piatti che un candidato politico.

Purtroppo negli anni i ricercatori non hanno trovato evidenze che confermino tali assunti, e già negli anni ‘90 progressivamente hanno superato il modello della audience indifferenziata (general audience), rigettando il “fan” inteso come individuo senza cervello e patologico, che recepisce acriticamente tutto ciò che passa sui media come una spugna.

Gli studiosi hanno compreso che l’audience non è mai meramente passiva, ma vi è sempre una forma di partecipazione, che si differenzia a seconda della personalità e del media stesso. La cultura partecipativa, i cui massimi teorici sono Larry Lessig e Clay Shirky, ha ottenuto grande diffusione proprio coi media digitali, ma nasce ben prima, con i vecchi media, laddove i contenuti venivano manipolati come fan art e fan fiction. Ovviamente la scala di “manipolazione” era decisamente inferiore. La televisione non favorisce la partecipazione, ma per i media digitali una forma di partecipazione è generalmente prevista, se non addirittura necessaria.

Bisogna però intendersi: partecipazione non è solo un'attività (es. ricerca tramite Google), ma proprio quella forma di partecipazione che ha trasformato il consumatore in prosumer (produttore-consumatore). Coi media digitali sono possibili una serie di interazioni con testi e immagini che consentono all’utente di modificare, alterare il contenuto originale e realizzare qualcosa di diverso con intenti ulteriori rispetto a quelli del contenuto originale. Pensiamo ai meme, ai remix, alla satira e alla parodia, tutte forme di comunicazione tipiche dei media digitali. Anche la semplice condivisione (share) di un contenuto online implica spesso una partecipazione, ad esempio inserendo un commento. Paradossalmente sono proprio queste forme di comunicazione (user generated content), cioè ciò che differenzia i media digitali dai media tradizionali, ad essere sempre più avversate da una combinazione di intenti tra politica e aziende (i produttori di contenuti).

La cultura partecipativa ha consentito di creare un nuovo modello di impatto dei media sull'audience, laddove il grado di attività (partecipazione) dipende da una serie di fattori, in primis dal media stesso. Henry Jenkins ha messo in evidenza che tale modifica è dovuta principalmente all’evoluzione della tecnologia (Quentin Tarantino’s Star Wars?: Digital Cinema, Media Convergence, and Participatory Culture) che ha permesso al cittadino medio di poter partecipare. Si tratta di un nuovo “consumismo” che si afferma proprio nell’ambiente digitale.

Archiviata l’idea che l’audience sia soltanto passiva, e che basti inviargli un messaggio perché questo, qualunque esso sia, venga recepito acriticamente (come una pallottola che penetra nel cervello, magic bullet), gli studiosi sono passati gradualmente al modello dell’audience attiva (Mass communication popular taste and organized social action). Il nuovo modello supera l’idea che il pubblico sia una massa indifferenziata, e incorpora analisi delle relazioni tra l’individuo, il contesto sociale e le ideologie espresse tramite i media, per comprendere l’impatto del messaggio veicolato. Il pubblico viene influenzato dai media e dai messaggi veicolati, recuperando un “significato” dal media, ma non qualsiasi significato.

Ad esempio, online spesso una persona condivide fake news non per la notizia in sé ma per dimostrare la propria appartenenza ad un "gruppo", la propria identità. Insomma, per dire "io odio quel politico", la notizia in sé è irrilevante.

Secondo l’active audience theory il pubblico non si limita a ricevere passivamente i messaggi, ma li decodifica e interpreta sulla base della propria ideologia e posizione sociale. Di conseguenza due persone diverse decodificano il messaggio in modo diverso, per cui l’impatto su di loro è differente (The rhetorical limits of polysemy). Insomma, quella che oggi si definisce “computational propaganda” è un qualcosa di completamente diverso da ciò che emerge nei dibattiti, anche politici, sulle fake news e la manipolazione online. Quello che è certo è che l’impatto dei media sul pubblico è molto più vario di quanto si creda, e che è ampiamente sovrastimato.

Katy Perry, un pericolo per la democrazia?

Tanto per fare un esempio, con riferimento alle fake news russe si fece una questione quantitativa. All’epoca si fecero varie cifre, fino a giungere alla conclusione che circa 10 milioni di persone potessero essere state esposte alle fake news russe. Sulla base della teoria della pallottola magica, il semplice fatto che Tizio fosse stato raggiunto dalla fake news faceva presumere che Tizio avesse cambiato idea. E questo presumendo, inoltre, che chiunque fosse stato esposto alla notizia la avesse letta davvero (lo scorrere il news feed viene conteggiato come visualizzazione, anche se poi l’articolo non viene realmente letto). La conclusione lapidaria era che la Russia aveva influenzato le elezioni americane.

Immaginate allora che pericolo devastante per la democrazia potrebbe essere la cantante Katy Perry, con i suoi 108 (cento-otto) milioni di follower su Twitter.

Non è la prima volta che premesse utilizzate per “spiegare” fenomeni del contesto digitale vengono meno a più attente analisi. La stessa “filter bubble theory” è stata sconfessata, almeno parzialmente, da una serie di studi che evidenziano che proprio l’ambiente digitale è quello dove una persona è maggiormente esposta a diversità di opinioni, rispetto ai media tradizionali (televisione e giornali) (Social Shaping of the Politics of Internet Search and Networking: Moving Beyond Filter Bubbles, Echo Chambers, and Fake News).

Leggi anche >> Polarizzazione, bolle ideologiche e quei miti da sfatare sull’informazione digitale

Il punto è che i dibattiti dei politici si adagiano su studi ormai superati, nati nell’epoca della televisione e che si basano sulle tradizionali attività giornalistiche, applicandoli però all’ambiente digitale senza comprendere appieno le differenze. Inoltre si minimizza, se non addirittura si nasconde, la correlazione tra l’information disorder e i media tradizionali (televisioni e giornali), concentrandosi esclusivamente sui media digitali. I politici capiscono di giornali e televisioni, quindi ragionano come se Internet fosse una grande televisione. Le conseguenze, con riferimento alle leggi che avanzano in merito, sono generalmente negative per l'ambiente digitale. E il problema non si risolve.

Le evidenze, invece, portano a concludere che le fake news hanno un impatto decisamente inferiore a quanto generalmente si crede. Prima di tutto perché online le persone sono esposte a fake news in misura minore di quanto si crede (esposizione non vuol dire lettura). Inoltre, la “partecipazione” dell’audience nell’utilizzo dei media comporta decisamente un minore impatto sulla personalità dell’individuo.

Gli individui già polarizzati di per sé, sono più propensi a leggere solo notizie che tendano a confermare le proprie idee, ma il rapporto di causa-effetto appare contrario, non è tanto il media che polarizza, quanto l’individuo già polarizzato che rifiuta di leggere notizie differenti dalla sua ideologia, che comunque gli vengono proposte nell’ambiente digitale. Il gruppo che si presenta più polarizzato appare quello formato dagli adulti dai 65 anni in su. Anche qui ampia sconfessione dell’idea che siano i ragazzi a subire l’impatto maggiore dai media digitali. I più giovani, infatti, avendo più dimestichezza con l’ambiente digitale, sono più capaci di cercare notizie da varie fonti, laddove i più anziani tendono a fermarsi alle prime che trovano. Gli anziani, in particolare, tendono a replicare la medesima “dieta” informativa che seguono offline, piuttosto che approfittare dei vantaggi dell’ambiente digitale.

L’identità e il leader

La “visione del mondo” dell'individuo dipende dall’identità dell’individuo stesso. La realtà sociale è costruita tramite la socializzazione, laddove la socializzazione primaria è acquisita durante l’infanzia. È qui che si forma principalmente l’identità sociale. La socializzazione secondaria si realizza tramite l’interazione con altri individui, e ogni nuova interazione, sia essa online o offline, può apportare una modifica al nostro modo di intendere la realtà. Ma sono le persone significative per noi (es. i genitori, l’insegnante, il politico di riferimento) a poter influenzare particolarmente la nostra visione del mondo.

Le fake news non necessariamente alterano la nostra visione del mondo, si limitano per lo più a confermare una visione del mondo che già ci è propria e si è formata tramite istituzioni quali scuola e famiglia (Berger e Luckmann (The Social Construction of Reality)). L’esposizione a fake news di incerta provenienza difficilmente può alterare la nostra “realtà”, questo al massimo può avvenire ad opera degli “influencer” se per noi diventano persone “significative”. Come il politico di riferimento. E questo è un problema maggiore al giorno d’oggi, dove la politica si incarna sempre più in un leader carismatico. È il leader che propone idee e valori che verranno veicolati tramite i media e introitati dal gruppo. I media ormai non hanno più il compito di veicolare informazioni razionali sui quali la gente si forma un’opinione per poi decidere. Il loro scopo è quello di veicolare simboli e modelli che verranno interiorizzati dal grande pubblico. È la parola del leader, il suo messaggio, che può, eventualmente, modificare la visione del mondo di un singolo individuo, non certo una qualsiasi fake news letta online.

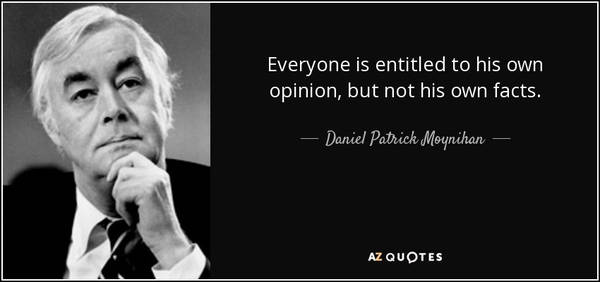

La quasi totalità delle iniziative in tema di fake news sono semplicemente ipocrite. Ipocrite perché vengono dai politici che abusano delle fake news, per poi autoassolversi, e le usano ampiamente per silenziare il dissenso. I politici hanno mentito da sempre, con l’avallo dei media tradizionali e dei giornalisti che gli reggono il microfono senza porre domande. Il problema è che i politici possono dire quello che vogliono, tanto nessuno glielo contesta (sicuramente non Facebook). Ma per i politici il problema è che in Internet i cittadini possono smascherarli. Forse è per questo che vogliono fortemente leggi contro le fake news? Per poter silenziare il dissenso? Per poter tornare ad autoassolversi con la complicità dei vecchi media ad accesso controllato (non aperti ai cittadini)?

La delega alle piattaforme del web

La politica, sia locale che comunitaria, si è mossa in maniera piuttosto semplicistica nell'affrontare il problema della disinformazione. In genere l’approccio è quello di ordinare alle piattaforme del Web, pena sanzioni economiche, di risolvere il problema senza nemmeno specificare quale sarebbe il problema. In tale quadro abbiamo dei codici di condotta realizzati attraverso gli accordi tra le stesse aziende, e alcune leggi, o proposte, che dovrebbero intervenire per regolamentare il fenomeno.

In vista di nuove elezioni, il problema si è posto anche con riferimento alle fake news politiche, e in particolare agli annunci contenenti disinformazione. In questa enorme confusione le piattaforme del web hanno deciso di agire, anticipando le mosse della politica, ma viaggiando in ordine sparso: Facebook consentirà ai politici di dire qualsiasi cosa; Twitter vieterà del tutto gli annunci politici; Google eliminerà il targeting iper-locale (hyper local).

Leggi anche >> Facebook e Twitter hanno deciso che i politici sono più uguali degli altri

Si tratta di tre differenti approcci con differenti conseguenze. Facebook sostiene che non spetta a loro stabilire ciò che è vero e cosa non lo è, e che il modo migliore è far decidere al pubblico: se un politico mente in un dibattito aperto aiuterebbe a denunciare queste bugie. È un approccio che il CEO Mark Zuckerberg ha difeso in un discorso alla Georgetown University. In realtà in questo modo, più che responsabilizzare il pubblico, si realizza un’ovvia discriminazione a favore dei politici. I politici potranno mentire (quindi violando anche le regole del social), nell’ambito dei processi di formazione della volontà politica e quindi proprio nei momenti più importanti per la società, di contro i normali cittadini saranno soggetti a scrutinio e valutazione se pubblicano notizie false. Insomma, due pesi e due misure, che poi, a ben vedere, è più o meno quello che accade quotidianamente in molti paesi, ad esempio proprio in Italia.

Per Twitter si tratterà di stabilire cosa è “politico” e cosa no. Già in questa fase sono possibili discriminazioni e errori. Inoltre mentre solo le formazioni politiche più danarose possono permettersi pubblicità su giornali e televisione, Internet democratizza questo aspetto permettendo a tutti di fare pubblicità online. Vietare pubblicità politiche del tutto, paradossalmente favorisce i partiti più importanti a discapito dei minori.

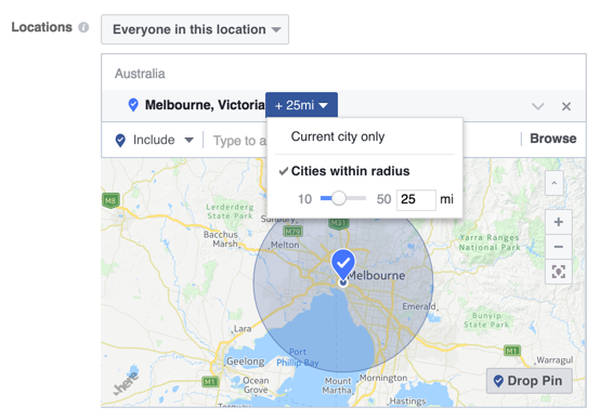

Probabilmente l’approccio migliore è quello di Google, che vieta la targettizazione iper-locale (granulare). Per capirci si parla di marketing hyper-local con riferimento alle pubblicità fortemente personalizzate e di nicchia. Ad esempio focalizzate all’interno di una città o di un’area specifica. Prima di radio e televisioni il marketing era sempre iper-locale (pensiamo al passaparola), solo che non era targettizzato, almeno non come lo è oggi.

La pubblicità iper-locale consente ai creatori di poter dire tutto ciò che vogliono senza che passi sui media mainstream, in questo modo finisce per essere quella che contiene le cose peggiori. Allargando l’area di target si rischierebbe di farla vedere a troppe persone e l’effetto potrebbe addirittura essere negativo.

Anche per Google, ovviamente, c’è il problema che dovrà stabilire cosa è politico e cosa no, ma il fatto di non consentire target troppo piccoli appare, probabilmente, l’approccio migliore. Se l’inserzionista non vorrà farlo, evidentemente è perché ha paura di mostrare a troppe persone l’annuncio. Forse è per questo che i portavoce di Trump sono contrari.

Il microtargeting

L’errore di Facebook sta nel fatto che se è il cittadino a dover decidere, dovrebbe anche avere le informazioni corrette per decidere. Cosa che ovviamente non è più. È piuttosto evidente che al giorno d’oggi siamo ben oltre la diversità di opinioni, che è un diritto tra l’altro, e siamo giunti al punto che i cittadini vivono in realtà epistemiologiche del tutto differenti. Tra elettori di destra e di sinistra (semmai queste etichette abbiano ancora un senso) esiste non solo una diversità di opinioni ma anche di realtà.

Sui vecchi media le falsità dei politici erano uguali per tutti, il messaggio era lo stesso per tutti. Oggi su Internet, grazie alla profilazione, sfruttando gli strumenti messi a disposizione dalle piattaforme del web, i politici possono indirizzare le pubblicità, anche false, con una precisione unica. Si chiama microtargeting. In questo modo i politici possono offrire un messaggio differente per ognuno, un messaggio che sia adatto a solleticare il singolo e le sue paure, e alimentare i suoi bias, la sua ideologia. Se il messaggio fosse uguale per tutti prima o poi qualcuno ne smaschererebbe la falsità, e tutti lo saprebbero. Ma questo non può accadere se il messaggio è personalizzato per ognuno di noi, unico. L’elettore vede solo il suo messaggio, e non quello diretto agli altri, e quindi non è più informato di cosa succede intorno a lui (e qui si realizza davvero la “filter bubble). Ecco che il vero pericolo, per la democrazia, non sono genericamente le fake news, ma le fake news personalizzate dei politici.

L'ex capo della sicurezza di Facebook, Alex Stamos, ci aiuta a comprendere che il problema del discorso politico è relativo all’amplificazione. Una cosa è ciò che si può dire in una chat privata (discorso uno a pochi), ben altro dovrebbe essere ciò che puoi dire a miliardi di persone contemporaneamente. Se Facebook amplifica il discorso politico per soldi, questo può essere evidentemente un problema. Anche Stamos perviene, in questo quadro, alla conclusione che probabilmente il modo migliore per gestire il problema è impedire la microtargetizzazione degli annunci politici. I politici mentono sempre, ma il problema è che non dovrebbero poter mentire confezionando delle menzogne su misura per ogni singolo elettore.

Lo stesso Garante per la protezione dei dati personali di Amburgo, Kaspar, ha messo in guardia contro questo uso dei dati: “Quando la Costituzione assegna ai partiti il compito di rappresentare la volontà popolare, non significa certamente usare metodi non trasparenti per manipolare la volontà degli elettori”. La percezione che tali metodi di invio di messaggi politici possano influenzare gli elettori, indipendentemente dalla loro efficacia, potrebbe minare ulteriormente la fiducia dei cittadini nella democrazia e nelle istituzioni.

Thomas Baekdal è ancora più categorico: l’idea che un politico per ottenere più voti possa dire una cosa a un gruppo di elettori e un'altra a un altro gruppo di elettori è pura corruzione politica. È qualcosa di incredibilmente dannoso ai fini di elezioni eque e per un processo democratico.

Il regolamento europeo in materia di protezione dei dati personali, però, potrebbe portare ad una svolta. Fondamentalmente la targettizzazione a fini politici dovrebbe essere soggetta a consenso espresso, e in particolare dovrebbe essere vietata per i minori. Secondo il Garante per la privacy irlandese, Helen Dixon, gli annunci microtargettizzati possono amplificare gli effetti dannosi della disinformazione, e per questo ha avviato un’indagine sull’uso di tali annunci da parte delle piattaforme del web, e per verificare la compatibilità con il regolamento europeo in materia di tutela dei dati personali. Dixon ha anche evidenziato il problema degli annunci indirizzati agli utenti più vulnerabili, come i minori.

Pensiamo che alcuni partiti politici in Italia indirizzano le pubblicità proprio ai minori tra i 13 e i 17 anni, inviando tramite la piattaforma di Facebook annunci anti-migranti. È evidente che si punta a quella fascia di età la cui identità sociale è ancora in formazione.

Conclusioni

La manipolazione è possibile, ma l’impatto non è chiaro. Il problema è che vi è un’ampia incomprensione delle dinamiche dell’ambiente digitale, per cui questo viene demonizzato a prescindere e ampiamente sovrastimato il suo effetto sulla società. Nel contempo si dimentica del tutto l’impatto che hanno le varie istituzioni (es. scuola e famiglia) e gli altri mezzi di comunicazione nel plasmare l’identità dell’individuo e la sua visione del mondo.

Leggi anche >> Come elaboriamo l’informazione che riceviamo e gli errori della nostra mente

Se un individuo tende a leggere dei messaggi (online o offline, è irrilevante) come rafforzativi delle sue ideologie, il problema nasce nella formazione della sua ideologia, non nel media. Secondo Kevin Arceneaux e Martin Johnson (More a Symptom Than a Cause: Polarization and Partisan News Media in America) la partigianeria di un media è il sintomo della polarizzazione, non la causa.

Il discorso, quindi, è decisamente più complesso da quello che normalmente ci propinano i politici, non è chiaro se per incomprensione del problema o anche per semplice calcolo. In fondo una Commissione (politica) che decida cosa deve essere pubblicato online e cosa no è il sogno proibito di ogni politico. I media tradizionali sono più semplici da controllare, avendo un editore di riferimento che sempre più spesso dipende, per la sua sopravvivenza, dai governi medesimi. Questo quando l’editore non si è fatto esso stesso politico. Controllare ciò che finisce online è, invece, decisamente più difficile.

A tal proposito il libro di Yochai Benkler, Robert Faris e Hal Roberts (Network Propaganda: Manipulation, Disinformation e Radicalization in American Politics) è illuminante. Con grafici e dati mostra che la maggior parte della disinformazione ottiene un effetto solo quando è “convalidata” da una fonte di notizie mainstream (nel libro Fox News). Solo dopo le fake news si diffondono. Come fosse un incendio.

Immagine in anteprima via Cambridgewireless