La disinformazione è una bestia dai mille volti: impariamo a riconoscerla

18 min letturaNegli ultimi anni il tema della disinformazione sembra aver assunto un’importanza cruciale per l’opinione pubblica. Eppure c’è molta confusione al riguardo: troppo spesso Tv e giornali trattano questo problema in maniera superficiale o estremamente vaga, abusando del termine ‘fake news’ e facendo ricadere tutta la responsabilità su Internet e sui social network. Per la politica questa ambiguità è un’occasione d’oro che permette di sfruttare il panico sociale in termini elettorali, oppure, molto peggio, di legiferare in maniera disinformata e ideologica ai danni della libertà di espressione e di informazione dei cittadini. ‘Leggi anti fake news’ sono state proposte nei regimi autoritari per sopprimere il dissenso; i disegni di legge ‘contro l’anonimato’, nati nel migliore dei casi dalla scarsa preparazione di chi presenta tali proposte; e la propaganda continua, incessante, su una non meglio specificata emergenza ‘fake news’, un termine vuoto e inappropriato che è stato di volta in volta utilizzato contro i social network, contro i giornalisti e i media scomodi, contro politici avversari, contro uno Stato, contro i cittadini.

Leggi anche >> Perché diciamo no a una Commissione parlamentare d’inchiesta sulle “fake news”

Per un dibattito sensato sull’informazione, i diritti, le libertà e le regole, bisognerebbe acquisire consapevolezza della complessità della questione e informarsi sul fenomeno, consultando esperti che lo studiano da anni. Per questo, abbiamo deciso di rilanciare su Valigia Blu il lavoro di Claire Wardle, direttrice di First Draft, non-profit dedicata alle sfide che l'era digitale pone in termini di fiducia e veridicità, che ha recentemente pubblicato una guida (in inglese) sul ‘disordine informativo’ intitolata “Understanding information disorder”.

Leggi anche >> Facile dire fake news. Guida alla disinformazione

L’approccio al problema della cattiva informazione da parte di Wardle è anzitutto linguistico e tassonomico, orientato a trovare soluzioni. Molti dei contenuti che vengono definiti ‘fake news’ non sono neanche notizie false di per sé, ma possono essere contenuti veri, decontestualizzati e diffusi sui social da profili veri, con l’obiettivo di danneggiare un avversario politico od organizzazioni sociali. Oppure può trattarsi di un mix di fatti reali e contenuti non verificati con obiettivi propagandistici. Può essere un meme, che cattura la nostra attenzione immediatamente e viene diffuso da migliaia di persone attraverso app di messaggeria istantanea come Whatsapp. O un video che è stato rallentato allo 0,75% della velocità per far sembrare ubriaca la persona che parla. O una foto vecchia spacciata per nuova. Parliamo di errori giornalistici, bufale, teorie complottiste, contenuti satirici decontestualizzati e utilizzati come fonti giornalistiche, diffusione di notizie non verificate, propaganda politica, informazioni false lanciate da siti che hanno l'unico scopo di generare profitti dal traffico online, media che abusano del click-baiting. Ieri il presidente Donald Trump per 53 minuti su Fox ha fatto tutto questo diffondendo in Tv teorie complottiste e notizie false ampiamente debunkate, rilanciate poi sui social in un circolo vizioso che si autoalimenta in continuazione.

Pretendere di etichettare l’insieme di questi fenomeni e azioni come ‘fake news’ è scorretto, pericoloso per i cittadini e autolesionista per i giornalisti, che dimostrano così la propria inadeguatezza come professionisti dell’informazione.

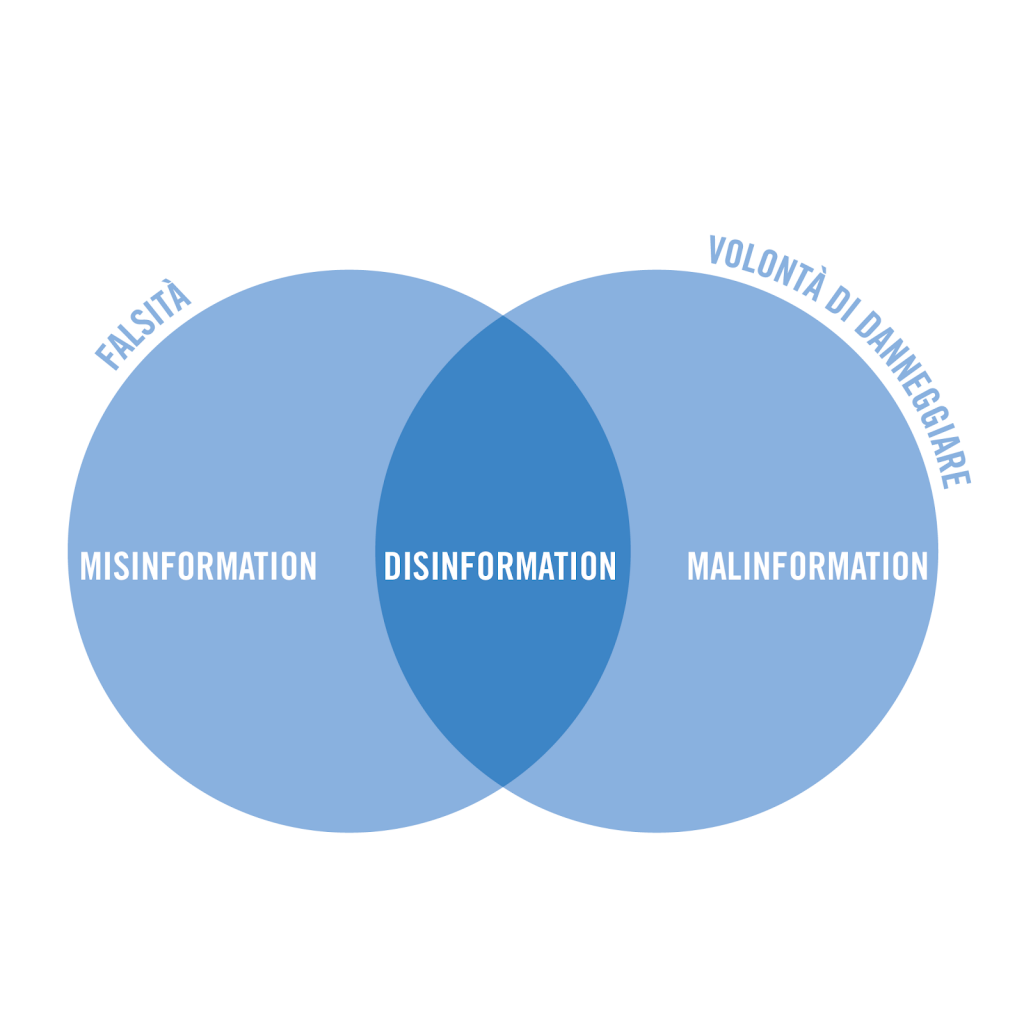

“A First Draft sosteniamo l'utilizzo dei termini che sono più appropriati per il tipo di contenuto; che si tratti di propaganda, bugie, cospirazioni, indiscrezioni, bufale, contenuti faziosi, falsità o media manipolati. Preferiamo anche usare i termini ‘disinformation’ (informazione falsa creata con l’obiettivo causare un danno), ‘misinformation’ (informazione falsa diffusa inconsapevolmente) o ‘malinformation’ (informazione che pur essendo vera è diffusa con l’obiettivo di causare un danno). Complessivamente ci riferiamo a tutto questo come ‘caos informativo’”, scrive Claire Wardle.

Essendo il suo lavoro disponibile solo in inglese, abbiamo deciso di preparare questo approfondimento a partire dalla guida di First Draft per condividere e diffondere questo lavoro che riteniamo importante per vivere in maniera consapevole e critica l'ecosistema informativo in cui siamo quotidianamente immersi.

Per una comprensione efficace del caos informativo: ‘disinformation’, ‘misinformation’ e ‘malinformation’

Facciamo innanzitutto una breve premessa: alcuni dei termini utilizzati da First Draft non hanno un corrispettivo esatto in italiano. La scelta delle parole ‘disinformation’, ‘misinformation’ e ‘malinformation’ racchiude delle sfumature di significato molto importanti per questa classificazione. ‘Disinformation’ può essere tradotto semplicemente ‘disinformazione’, che il Dizionario Treccani definisce come “Diffusione intenzionale di notizie o informazioni inesatte o distorte allo scopo di influenzare le azioni e le scelte di qualcuno (per es., dei propri avversari politici, dei propri nemici in un conflitto bellico, e sim.)”. Non esiste invece un consenso su come tradurre ‘misinformation’ o ‘malinformation’ in italiano, nel primo caso alcuni usano il calco linguistico ‘misinformazione’ che però perde l’efficacia originale. In questo capitolo spiegheremo il loro significato, utilizzando il termine inglese.

Come abbiamo letto anche nella definizione della Treccani, la disinformazione consiste nella creazione di contenuti intenzionalmente falsi con l’obiettivo di causare un danno a una persona, a un gruppo o a una causa sociale. Può essere motivata da vari fattori: per guadagnare soldi, per creare pressione politica (nel proprio paese o all’estero) oppure semplicemente per il gusto di causare problemi e generare confusione.

Quando la disinformazione viene diffusa sui social network spesso può convertirsi in ‘misinformation’: nei casi in cui il contenuto disinformativo sia condiviso da una persona che non è consapevole che è falso o ingannevole. Questa dinamica è frequente sui social network e in molti casi le persone che diffondono informazioni false sono convinte di aiutare la loro cerchia di contatti. Sui social costruiamo la nostra identità online attraverso le nostre foto personali, gli status con i quali esprimiamo opinioni o raccontiamo un episodio divertente della nostra giornata, ma anche con la condivisione di articoli pubblicati da altri che si avvicinano al nostro modo di pensare. L’esigenza psicologica di esprimersi come parte di un gruppo (per esempio come membri di un partito politico, attivisti preoccupati per il cambiamento climatico, genitori che non vaccinano i propri figli, etc.) è l’impulso che porta a condividere con i propri contatti informazioni ritenute importanti e spesso in linea con il sistema di valori condiviso.

La terza categoria che menziona First Draft è la ‘malinformation’, ossia un’informazione vera condivisa con l’obiettivo di causare un danno. Un esempio noto a tutti a livello mondiale è l’hackeraggio da parte di agenti russi delle email di Hillary Clinton, durante la campagna elettorale del 2016, con l’obiettivo di danneggiare la reputazione della candidata. Il paradosso in questo caso è che il contenuto delle email era di per sé irrilevante, non era utile a creare nessun tipo di scandalo, ma la decontestualizzazione dei fatti, il mix tra questa notizia e informazioni false create appositamente, l’ambiguità e l'ossessione con cui la notizia è stata trattata su certi media americani hanno contribuito a creare un caos informativo che favoriva una narrazione ostile nei confronti di Clinton. Tutto a partire dalla diffusione di informazioni autentiche diffuse con l’obiettivo di danneggiare una persona: ‘malinformation’ appunto.

Un altro esempio di 'malinformation' (aspetti di una vicenda veri usati in modo distorto e manipolato per attaccare un avversario politico) è la propaganda fatta dal leader del M5S Luigi Di Maio a proposito del “caso Bibbiano”, ossia l’inchiesta “Angeli e Demoni” della Procura di Reggio Emilia riguardante casi di affidi familiari ad opera dei servizi sociali della provincia. In quel caso, Di Maio pubblicò una card raffigurante il sindaco PD di Bibbiano, Carletti (autosospesosi dal partito), con la scritta “arrestato” e sotto “affari con i bimbi tolti ai genitori”.

Secondo Di Maio il Partito Democratico (qui rappresentato dal sindaco Carletti) lucrerebbe sui minori. «Un altro business, orribile, sui minori. (...) Quello che viene spacciato per un modello nazionale a cui ispirarsi sul tema della tutela dei minori abusati, il modello “Emilia” proposto dal PD, si rivela oggi come un sistema da incubo: bambini ”selezionati” e sottratti illegittimamente alle famiglie, per poi venire consegnati in una sorta di “affido horror” a personaggi discutibili, tra i quali titolari di sexy shop, pedofili, gente con problemi mentali». Nel post Di Maio parla di un «vero e proprio “sistema”», che coinvolge «autorevoli rappresentanti delle istituzioni.

Il sindaco Carletti era stato arrestato ma non per la gestione degli affidi di bambini ma per «abuso d’ufficio e falso. Gli veniva contestato di aver violato le norme sull’affidamento dei locali dove si svolgevano le sedute terapeutiche, ma non è coinvolto nei crimini contro i minori». Inoltre, l’esistenza di un “sistema Bibbiano” era stata sgonfiata un mese fa anche dai risultati di un’indagine interna del Tribunale per i minorenni di Bologna (lo stesso che si è occupato anche dei casi dell’inchiesta “Angeli e Demoni”) condotta sui documenti relativi alle richieste di affidamento fatte dai servizi sociali della Val d’Enza. Secondo i giudici, su 100 richieste di affidamento presentate dai servizi sociali della Val d’Enza il tribunale ne aveva accolte solo 15, smentendo quindi l’ipotesi di una connivenza dei giudici. E recentemente un'indagine di una commissione tecnica composta da otto esperti tra professori universitari e medici è arrivata alla conclusione che "il sistema Bibbiano non esiste".

L’uso di quest’ultima tecnica è aumentato negli anni, da un lato perché qualsiasi contenuto che contenga un pizzico di verità funziona meglio se si vuole coinvolgere e convincere le persone, ma la guida di First Draft spiega che può essere una risposta da parte dei disinformatori al tentativo dei social network di bloccare la diffusione di notizie false. Fatta la legge trovato l’inganno: da quando Facebook ha deciso di rinforzare il proprio sistema di controllo, servendosi di fact-checker indipendenti, chi produce disinformazione ha capito che se si utilizzano contenuti veri decontestualizzati e rimodellati in maniera ingannevole è più difficile essere scoperti dai sistemi di intelligenza artificiale di Facebook. E in certi casi la ‘malinformation’ non infrange neanche le linee guida del social network.

Sette tipologie di disinformazione e ‘misinformation’

All’interno di ciò che definiamo disinformazione, ‘misinformation’ e ‘malinformation’, la guida di First Draft identifica sette modi di disinformare, una categorizzazione creata da Claire Wardle nel 2017 con l’obiettivo di abbandonare il termine vago e ingannevole ‘fake news’ e studiare il fenomeno con un approccio orientato alle soluzioni. Queste sette categorie (che spesso si sovrappongono) sono: contenuto fabbricato, contenuto manipolato, contenuto diffuso da impostori, falso contesto, contenuto ingannevole, falsa connessione, satira o parodia.

Contenuto fabbricato

Un contenuto fabbricato è per definizione un’informazione falsa. Esempio classico: l’endorsement di Papa Francesco al candidato Donald Trump durante la campagna elettorale del 2016. Il post era stato pubblicato da un sito chiamato WTOE5 che in quel periodo si dedicava a pubblicare articoli falsi sulla politica americana. C’è da dire che questa notizia falsa ha avuto tanta visibilità soprattutto grazie agli articoli che la citavano come esempio della disinformazione durante la campagna elettorale. Difficile dire quale sia stato il suo impatto reale.

Episodi simili in Italia ce ne sono tanti, anche da noi esistono siti dedicati alla fabbricazione incessante di notizie false e che spesso riescono a diventare mainstream con la complicità di alcuni politici che rilanciano queste notizie come parte della loro propaganda, come nel caso del cospirazionismo attorno alla figura di George Soros e alla cosiddetta “sostituzione etnica”, più volte utilizzato da Salvini e da altri politici della destra italiana.

Un episodio che abbiamo trattato su Valigia Blu è la bufala del 2018 delle carte prepagate ai migranti finanziate da Soros attraverso UNHCR (l'Alto commissariato delle Nazioni Unite per i rifugiati), con l'obiettivo di "foraggiare l'invasione". Una notizia falsa inventata da un sito xenofobo sloveno che hanno contribuito a diffondere in Italia alcuni media e alcuni politici ospiti di trasmissioni televisive.

Contenuto manipolato

Quando parliamo di manipolazione di contenuti ci riferiamo principalmente a materiale multimediale modificato per alterarne il significato o il contesto: foto ritoccate con Photoshop o semplicemente ritagliate per eliminare parte del contesto, video rallentati, etc.

Ultimamente si parla molto dei ‘deepfakes’, ossia video contraffatti creati con l’aiuto dell’intelligenza artificiale, che secondo alcuni potrebbero essere la nuova frontiera della disinformazione, specialmente in campo politico (uno studio ci dice che, per ora, questa tecnologia è usata principalmente per creare porno e non notizie false). Eppure l’esempio più recente di manipolazione audiovisuale non ha avuto bisogno di grandi tecnologie o tecniche raffinate per diventare virale: stiamo parlando del video della presidente della Camera statunitense Nancy Pelosi, modificato con l’obiettivo di farla apparire ubriaca mentre parla in pubblico. Il video disinformativo è stato creato semplicemente rallentando il video originale, un dettaglio che ci fa capire che la disinformazione a volte può essere creata con il minimo sforzo.

Altro esempio di contenuto manipolato è quello di cui è stata vittima Emma Gonzalez e tre delle sue compagne sopravvissute alla sparatoria della scuola di Parkland, Florida. Durante una sessione fotografica per la rivista Teen Vogue, la ragazza era stata ritratta strappando un bersaglio proveniente dai poligoni di tiro americani, per lanciare un messaggio contro le armi da fuoco. Nella stessa occasione era stato girato anche un video breve di quel gesto. Sia l’immagine che il video sono stati successivamente manipolati e il bersaglio di carta è stato sostituito con la prima pagina della costituzione americana. Il video falso è diventato talmente virale che è stato diffuso anche da alcune celebrità, come Alec Adam Baldwin (il tweet è stato poi rimosso).

Altre volte basta ritagliare una foto per fare disinformazione, come nel caso delle false file ai Caf per chiedere il reddito di cittadinanza. Il Mattino aveva ingannato i propri lettori su un presunto assalto ai Caf per il reddito di cittadinanza, usando una foto che in realtà risale al 2010 e tagliando volutamente l'insegna delle Poste per spacciare la sede come quella dei Caf.

Contenuto diffuso da impostori

Vi è mai capitato di vedere pubblicato da uno dei vostri contatti su Facebook un articolo proveniente da un sito che ricorda un giornale vero? Questo tipo di contenuti generalmente imita la grafica o la url di una fonte autorevole con l’obiettivo di ingannare i più distratti. Seppur in maniera inconscia, il nostro cervello è alla continua ricerca di indicatori di credibilità: un logo, un brand possono fare la differenza quando parliamo di informazione.

Questo non accade solo con gli articoli ma anche con i contenuti audiovisivi, come video o foto: è sufficiente aggiungere un logo per far sembrare vera qualsiasi “notizia”.

Un esempio raccolto da First Draft nella sua guida è quello di un sito belga che imitava alla perfezione il quotidiano francese Le Soir: la copia era talmente accurata che tutti i link della pagina mandavano al sito vero del giornale. Tutto questo per poter diffondere la notizia falsa che la campagna elettorale di Macron era stato finanziata dall’Arabia Saudita.

Falso contesto

In questo caso stiamo parlando di contenuti autentici che vengono diffusi assieme a informazioni di contesto diverse.

First Draft presenta come esempio un tweet diventato virale all’indomani dell’attentato islamista di Londra del 2017, quando un’automobile investì una folla di persone ferendone 50 e uccidendone 4. Nel tweet appare la foto di una donna di religione islamica che attraversa il Westminster Bridge e passa davanti ad alcune vittime dell’attentato. Il testo che accompagna la foto la accusa di essere indifferente davanti al terrore dell’attentato. La foto è reale, non è un falso, ma le informazioni di contesto sono completamente inventate. In un’intervista successiva alla diffusione dell’immagine, la donna ha dichiarato che in quel momento era traumatizzata ed era al telefono con una persona cara e che, per rispetto, non ha guardato le vittime mentre passava davanti. Oggi sappiamo che quell’account islamofobo era parte di una campagna di disinformazione russa.

Un altro esempio è questo tweet, circolato nel 2018, nel quale appare un bambino in una gabbia. L’autore, un giornalista, dice di aver visto la foto circolare su Facebook e ha deciso di usarla per criticare la politica di immigrazione dell’amministrazione Trump, che in quel periodo era al centro del dibattito pubblico per via della decisione di separare i figli dei richiedenti asilo dai propri genitori. La notizia è reale, Trump ha effettivamente messo in atto questa politica ed esistono molte foto che testimoniano la crudele realtà nella quale si traduce questa scelta, però la foto scelta da Jose Antonio Vargas è in realtà una messa in scena preparata durante una protesta contro Trump. La foto in questo caso, quindi, non è autentica. Il tweet ha ricevuto più di 20mila retweet. Molti hanno fatto notare su Twitter che la foto era una messa in scena. L’effetto boomerang di questo “errore” giornalistico è che molte persone, dopo aver letto o scoperto attraverso la tv che la foto era “falsa”, avranno avuto la sensazione che fosse tutta una “fake news”, che non esistesse tale politica migratoria. È così che funziona il caos informativo.

Le buone intenzioni, infatti, non ci mettono certo al riparo dall’essere diffusori inconsapevoli di caos informativo. Nel 2017 i media di tutto il mondo hanno rilanciato un video del National Geographic in cui si vede un orso polare che vaga alla ricerca di cibo nell’isola di Baffin, in Canada. Le immagini dell’animale denutrito e sofferente, che si trascina sulla terra ferma priva di ghiaccio, sono diventate velocemente il simbolo degli effetti del cambiamento climatico sulla fauna artica. Tutti i media che hanno ripreso la storia hanno sottolineato un fatto: l'orso stava morendo di fame per colpa del cambiamento climatico. La foto, però, per quanto sia carica di forza e simbolismo non ha alcun valore documentale: quell’orso non stava morendo di fame a causa del cambiamento climatico. Le immagini erano state girate ad agosto, quando la scomparsa del ghiaccio è naturale nell’habitat degli orsi polari di quella regione, per una campagna di National Geographic sul cambiamento climatico. Un obiettivo nobile e un problema reale, senza ombra di dubbio. Ma la foto era semplicemente uno strumento di “manipolazione emotiva” e non aveva il valore giornalistico che molti media in tutto il mondo hanno provato a dargli.

Contenuto ingannevole

Il contenuto ingannevole può presentarsi in diverse forme: un titolo fuorviante, virgolettati falsi, affermazioni vere ma decontestualizzate, l’uso di statistiche in maniera parziale e interessata, etc.

Claire Wardle racconta come trovare una definizione di ‘contenuto ingannevole’, contrariamente a quello che si potrebbe pensare, sia un esercizio difficile. “Semplicemente lo sai. È ingannevole”. Il concetto di ingannevole è complesso da definire, secondo Wardle, perché ha a che fare con il contesto, con le sfumature di significato, con le omissioni che sono state fatte, con le intenzioni di chi ha prodotto quel contenuto, o può trattarsi di una foto tagliata in modo da alterarne il significato. “Questa complessità è la ragione per cui siamo ancora lontani dall’avere un’intelligenza artificiale capace di segnalare questo tipo di contenuto”, scrive Wardle.

Secondo uno studio del 2018 pubblicato da Knight Foundation e Gallup, la maggior parte degli americani hanno perso la fiducia nei media tradizionali (64%) e le ragioni principali secondo gli intervistati sono la mancanza di accuratezza e la faziosità.

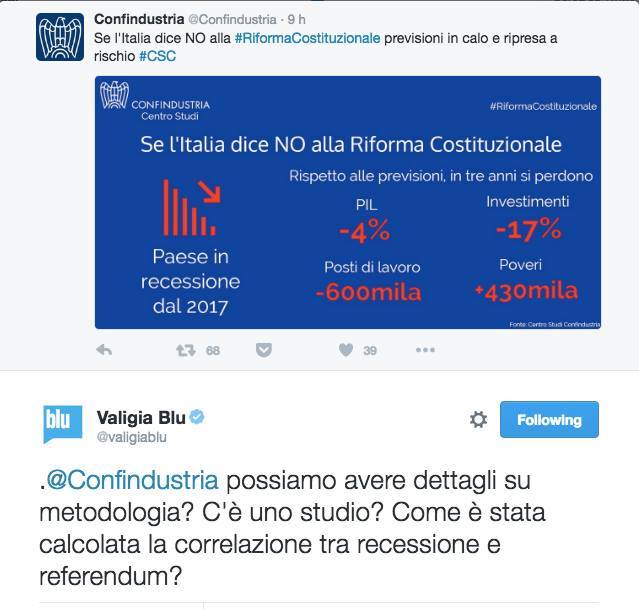

Un caso eclatante di manipolazione e uso di statistiche false per creare panico sociale riguarda Confindustria, che nel 2016, durante il dibattito sul referendum costituzionale, aveva pubblicato dei dati che facevano presagire una vera e propria catastrofe in caso di vittoria del “No”. Addirittura ci sarebbero stati 430mila poveri in più. Tutto questo senza mai dire quale fosse stato il metodo di rilevazione di simili dati, nonostante le continue richieste di Valigia Blu di spiegare la correlazione fra vittoria del ‘No’ (che significava sostanzialmente lasciare la Costituzione così com'è) e l'aumento della povertà.

Un altro esempio molto grave di manipolazione è del 2017, quando diversi quotidiani nazionali nel raccontare il presunto stupro a Firenze di due studentesse americane da parte di due carabinieri in servizio, hanno riportato dei dati falsi sulle denunce di violenze sessuali nel capoluogo fiorentino, scrivendo che ogni anno a Firenze ci sono “dalle 150 alle 200 denunce di stupro presentate da ragazze americane” e che “il 90% risultano false”.

Falsa connessione

Wardle parla di ‘false connection’, che abbiamo tradotto come ‘falsa connessione’, ossia quando il contenuto è presentato in maniera ingannevole ai lettori.

Come abbiamo scritto nell’introduzione, spesso i media trattano in maniera inadeguata il problema del caos informativo. In parte questo è dovuto probabilmente al fatto che provano a semplificare una complessità che non conoscono e cadono così nell’uso del termine-jolly ‘fake news’. Un altro aspetto grave dell’appiattimento informativo su questo argomento è il fatto che molti giornali e telegiornali parlino di ‘fake news’ come se questo problema non riguardasse in assoluto i media tradizionali ma solo Internet, come se fosse tutta colpa di quei ‘dannati’ social network. Sappiamo che è falso e più volte abbiamo parlato della disinformazione e dell’allarmismo creato dai media attorno a una non tanto precisata ‘emergenza fake news’.

First Draft dedica una categoria alle cattive pratiche delle redazioni che contribuiscono ad aggiungere caos, rumore, confusione e che di fatto indeboliscono ulteriormente la fiducia dei cittadini nella stampa.

Tra queste pratiche che inquinano costantemente l’ecosistema informativo possiamo citare il linguaggio sensazionalista (ci sono giornali che costruiscono tutta una carriera su titoli sguaiati e intenzionalmente ingannevoli) o il ‘clickbait’, a cui qualche anno fa abbiamo dedicato un articolo su Valigia Blu. Un altro esempio possono essere i virgolettati falsi, una pratica molto diffusa nella stampa italiana, ossia quando il titolista semplifica, condensa (spesso in maniera ingannevole) il contenuto di un’intervista in un’affermazione che non è mai stata pronunciata e la inserisce nel titolo tra virgolette.

Recentemente Huffington Post ha pubblicato un articolo che nel titolo riportava il virgolettato di un'affermazione che il leader di Italia Viva ed ex segretario del Pd, Matteo Renzi, avrebbe fatto a margine della trasmissione Porta a Porta su Rai 1: "Un'alleanza con Salvini? Mai dire mai". L'ex premier a Porta a Porta: "Il leader della Lega si sposterà al centro". In realtà, Renzi non ha mai pronunciato parole del genere. A farlo è stato Virman Cusenza, diretto del Messaggero. L'articolo di Huffington Post è stato rimosso senza alcuna riga di spiegazione.

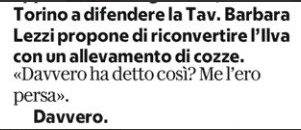

Oppure in un'intervista su Repubblica al segretario del Pd Nicola Zingaretti l'intervistatore chiede cosa ne pensa della proposta della senatrice del M5S Barbara Lezzi di riconvertire l'Ilva di Taranto in un allevamento di cozze. In questo caso viene fatta passare per vera ai lettori un'affermazione che la senatrice del M5S non ha mai fatto. Questa dichiarazione, pronunciata durante la trasmissione radiofonica Radio Anch'io su RadioRai1,

"Nonostante il siderurgico, Taranto è la città con il più alto tasso di disoccupazione in Puglia. Vogliamo intervenire senza essere definiti ostili ad Accelor Mittal, ostilità che non c'è e lo ribadisco, ma è anche giusto dare un'alternativa a Taranto - prosegue il ministro all'indomani del tavolo istituzionale che si è svolto in Prefettura -, una città splendida che purtroppo è stata molto trascurata negli ultimi decenni. Vogliamo rimettere in piedi il centro storico, costituire lì un Tecnopolo, un centro di ricerca per l'innovazione".

è diventata questo nell'intervista:

Satira o parodia

Una grande sfida dell’era del caos informativo, scrive Wardle, è il fatto che la satira e la parodia siano spesso usate strategicamente per proteggersi dai fact-checker e diffondere informazioni false e cospirazioni a un livello più subdolo, sapendo che davanti a qualsiasi contestazione il creatore può obiettare che si tratta di un contenuto parodistico, fatto ‘per scherzare’, che ‘non dev’essere preso sul serio’.

Un’altra ragione per cui la satira può essere un potente strumento di disinformazione è che, spesso, chi è in contatto diretto con la fonte originale di tali contenuti è in grado di decifrare il contesto satirico del messaggio (aiutato dal fatto che conosce la fonte e la tipologia di contenuti che pubblica), ma nel condividerlo a sua volta questa consapevolezza non viene trasmessa, si perdono gli indizi contestuali che aiutano a decifrare il messaggio come satirico, e alcune persone potrebbero considerare quel contenuto come informativo.

Non dobbiamo però pensare che il problema siano le persone che condividono articoli di Lercio (sito notoriamente satirico) con altre persone che non sanno cosa sia Lercio. Il fatto che la condivisione di contenuti genuinamente satirici possa ingannare involontariamente alcuni dei nostri contatti è solo un aspetto di questa dinamica, il vero pericolo è quando chi usa la satira per mascherare i propri contenuti disinformativi prova a sfruttare questa dinamica con l’obiettivo di viralizzare falsità e danneggiare persone o gruppi sociali.

Un esempio possono essere le campagne razziste che creano meme ‘satirici’ per diffondere informazioni intenzionalmente false e ingannevoli. O possiamo riscontrare la stessa strategia negli attacchi personali all’ex Presidente della Camera Laura Boldrini. O basti pensare ai tanti siti che diffondono periodicamente notizie false e odio, che si limitano a scrivere la dicitura “web satirico” nella pagina “Chi siamo” del loro sito.

Un esempio tra i tanti in Italia può essere l’episodio che riguarda Laura Boldrini e Alitalia. L’anno scorso, Dagospia ha pubblicato la fantomatica lettera di lamentele di un passeggero, che denunciava che l’ex presidente della Camera gli avrebbe “rubato” il posto su un volo Alitalia Genova-Roma. Sia l’ex presidente della Camera che Alitalia hanno immediatamente smentito l’accaduto, eppure questa storia, che da Dagospia è rimbalzata su altri blog e pagine social, ha dato luce a status indignati, meme e vignette satiriche che hanno continuato a propagare la bufala.

La ‘satira’ propagandistica e disinformativa negli ultimi anni è diventata parte integrante della comunicazione dei partiti politici, una prassi che oltre a produrre contenuti intenzionalmente ingannevoli avviene nella totale mancanza di trasparenza, spesso attraverso l’uso di ‘sockpuppet’, ossia di profili falsi creati ad hoc.

First Draft non si riferisce quindi alla satira o alla parodia in senso stretto, ma a chi utilizza una tattica ben precisa per diffondere odio e disinformazione servendosi della satira solamente come pretesto.

Conclusioni

Il caos informativo, come abbiamo visto, è una bestia dai mille volti, un fenomeno complesso - che non può essere ridotto solamente alle notizie false - a cui contribuiscono con attività di manipolazione online anche le agenzie governative e i partiti politici come attestato dall'ultimo rapporto 2019 sulla disinformazione attraverso i social media, firmato dall'Università di Oxford.

In alcuni casi è sottovalutato – specie quando parliamo di clickbait o di errori commessi in “buona fede” dai giornalisti – ma anche un piccolo errore a volte può contribuire ad alimentare la disinformazione, soprattutto se parliamo di argomenti delicati, come la politica, la religione, il cambiamento climatico o i migranti.

Alcune tecniche di disinformazione sono sofisticate e organiche: a volte, si tratta di vere e proprie campagne di propaganda che fanno leva sulla partecipazione (spesso inconsapevole) delle persone alla diffusione di un messaggio falso. E l’uso di informazioni false è solamente una parte della loro strategia.

Come dimostra la guida di First Draft, per poter difendersi dalla disinformazione è necessario saperla riconoscere in tutte le sue diverse sfaccettature.

Il ruolo dei giornalisti dovrebbe essere conoscere il funzionamento dell’informazione e creare ordine e chiarezza dove c’è caos. Ma, oggi più che mai, anche il lettore riveste il ruolo di divulgatore e dovrebbe essere in grado di utilizzare queste conoscenze per contribuire in maniera virtuosa all’ecosistema informativo in cui tutti noi viviamo.

Immagine in anteprima via dubawa.org