Come funziona la macchina di disinformazione russa

|

|

“Se l'informazione è tossica, la democrazia non può funzionare. Se l'informazione è manipolata, le persone non hanno un'idea chiara di ciò che sta accadendo. L'informazione è l'olio del motore della democrazia. Dobbiamo curare la qualità dell'informazione perché è la linfa, il sangue, l'olio, ciò che fa funzionare le nostre democrazie”.

Il Vicepresidente della Commissione Europea Josep Borrell ha parlato in questi termini di politiche della sicurezza aprendo la conferenza “Oltre la disinformazione” lo scorso 7 febbraio. Il Servizio europeo per l’azione esterna (SEAE) ha riunito le principali istituzioni e rappresentanti politici per discutere delle minacce di manipolazione e interferenza delle informazioni estere, quelle che in gergo vengono denominate con l’acronimo FIMI (Foreign Information Manipulation and Interference). Le quali, in particolare, fanno riferimento a uno specifico modello di comportamento, per lo più non illegale, che minaccia o ha il potenziale di avere un impatto negativo su valori, procedure e processi politici nazionali e internazionali. Tale attività è di carattere manipolativo, condotta in modo intenzionale e coordinato da attori statali o non statali, all'interno e all'esterno del proprio territorio.

“Questa guerra non riguarda solo l’uso di esplosivi, bombe, proiettili e l’uccisione di persone. La Russia sta usando la manipolazione e l’interferenza delle informazioni come strumento cruciale di questa guerra.”

L’industria della disinformazione russa

La propaganda pro-Cremlino ha preparato il terreno dell’invasione ucraina con largo anticipo rispetto all’invasione su larga scala del febbraio 2022. Come una vera e propria industria, la catena di produzione di disinformazione ha alternato diverse fasi. Da decenni veniva diffusa l’idea che l’Ucraina non fosse neanche uno Stato, che la fratellanza tra il popolo ucraino e quello russo fosse stata minacciata dall’Occidente. Questa narrazione ha iniziato a virare nel 2021 verso un altro immaginario propagandistico, in cui l’Ucraina è governata da ideologie naziste, imperialiste e neo-coloniali e gli Stati Uniti hanno un ruolo attivo nell’influenzare la falsa alleanza transatlantica con Europa e NATO. Con queste premesse, la Russia pone le basi per rappresentare il Cremlino come vittima di una strategia geopolitica internazionale, alla quale diventa quindi necessario rispondere con una guerra che “garantisca sicurezza per la Russia”. Nel discorso tenuto all’alba del 24 febbraio 2022 (qui la completa traduzione) Putin crea un parallelismo con l’invasione che la Russia ha subito dalla Germania nazista nel giugno del 1941, che ha trovato l’URSS impreparata. “Non commetteremo questo errore una seconda volta. Non abbiamo il diritto di farlo”.

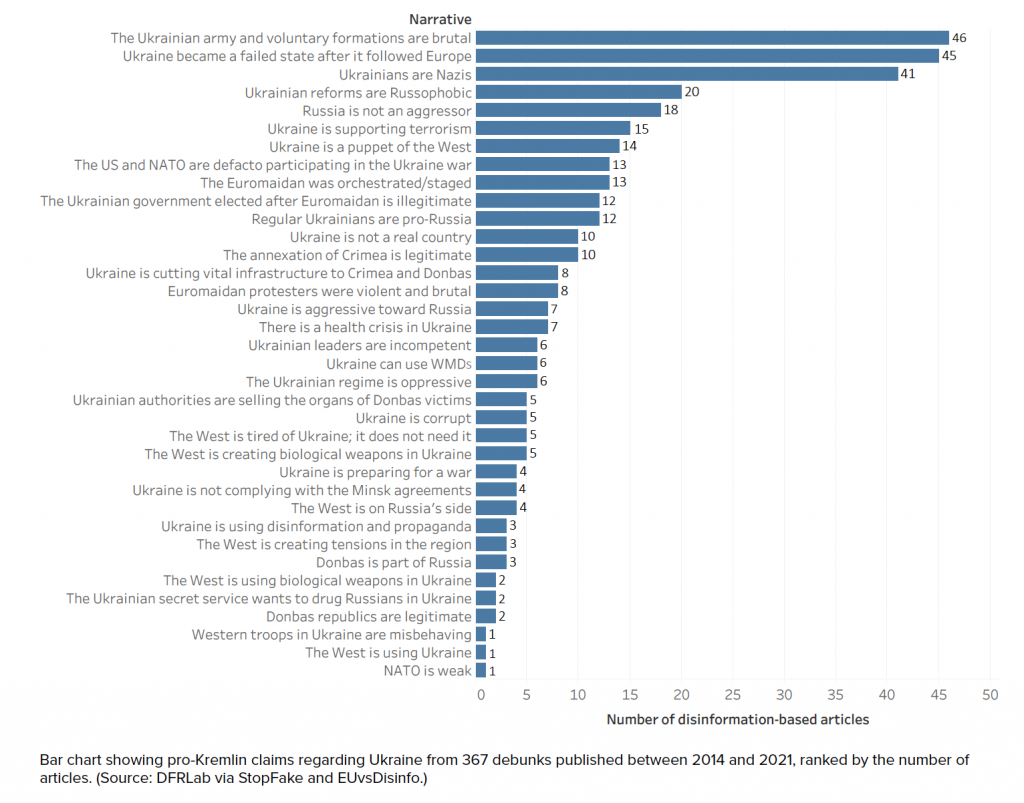

Un report dell’Atlantic Council, in collaborazione con il Digital Forensic Research Lab (DFRLab) ha analizzato 9.000 notizie condivise tra il 2014 e il 2021 su cui StopFake e EUvsDisinfo hanno effettuato fact-checking. Il DFRLab ha selezionato 367 affermazioni sull'Ucraina pubblicate da fonti pro-Cremlino, per un totale di trentasei categorie narrative, molte delle quali si sono ripetute nel corso degli otto anni. Le narrazioni più frequenti a favore del Cremlino sono state: "L'esercito ucraino e le formazioni volontarie sono brutali", "L'Ucraina è diventata uno Stato fallito dopo aver seguito l'Europa" e "Gli ucraini sono nazisti", temi che continuano a essere presenti nella propaganda a favore del Cremlino.

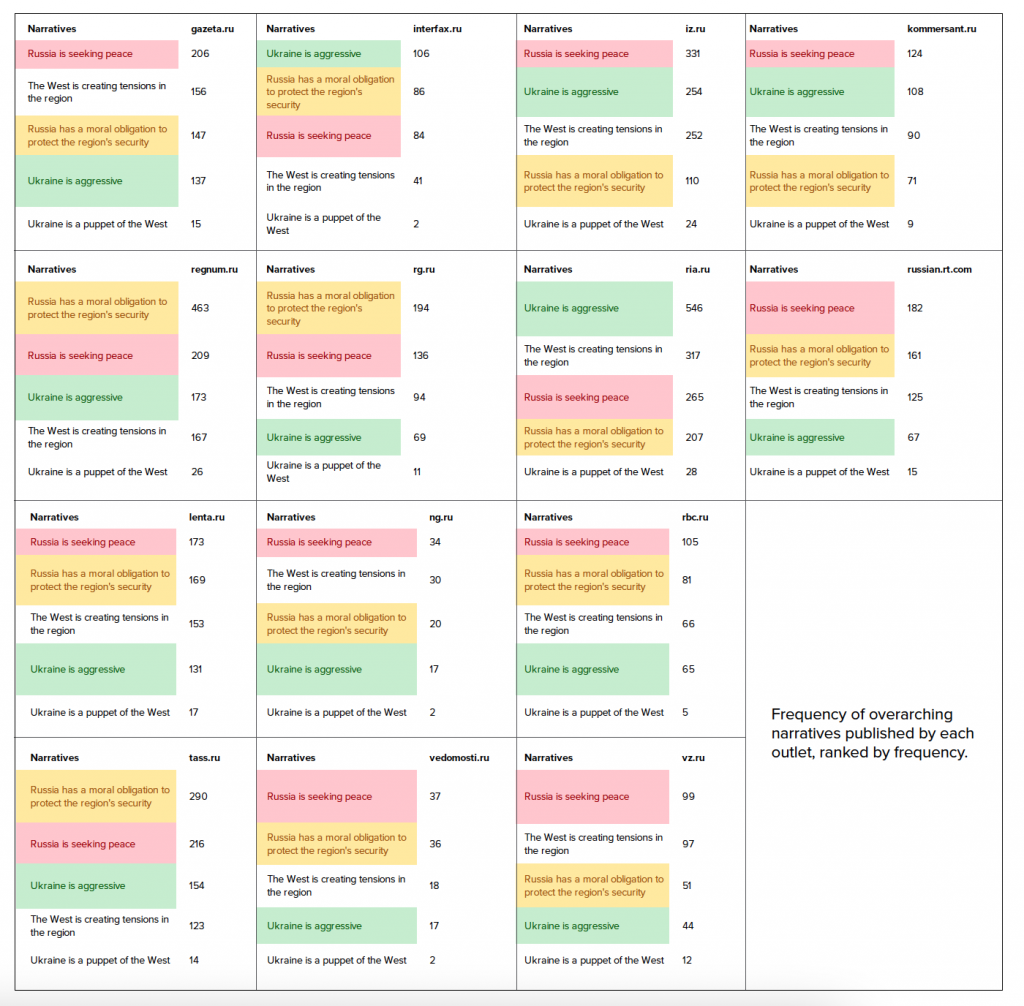

Queste retoriche hanno caratterizzato i 70 giorni precedenti lo scoccare dell’invasione in Ucraina e le principali 14 testate pro-Cremlino hanno continuato a supportarle con un network comune di fonti citate. Tra le strategie dell’industria dell’informazione russa, l'approvvigionamento circolare (che richiama i principi dell’economia circolare) è una di quelle più semplici ed economiche. Genera una facciata di credibilità attraverso la creazione di una camera d'eco mediatica, prolungando la rilevanza di una determinata narrazione attraverso la ripetizione e il riciclaggio degli stessi contenuti su diversi canali.

Ma le retoriche non si limitano ad attaccare il solo territorio ucraino: la Moldova e la regione della Transnistria si trovano in una situazione precaria come vittime collaterali sin dall'inizio dell'invasione russa. Nei primi mesi del 2023 sono entrate di nuovo nel mirino dei media russi. Il 23 febbraio 2023, il canale Telegram del Ministero della Difesa russo ha pubblicato informazioni su un presunto attacco ucraino alla regione separatista. La notizia si è rapidamente diffusa su Internet e il meccanismo dell’approvvigionamento circolare si è messo in moto: gli alti funzionari russi e i media pro-Cremlino hanno diffuso ampiamente le accuse sui propri canali; contenuti che sono stati poi ri-condivisi sui numerosi gruppi Telegram, inducendo sia i funzionari moldavi che quelli ucraini a smentire le accuse.

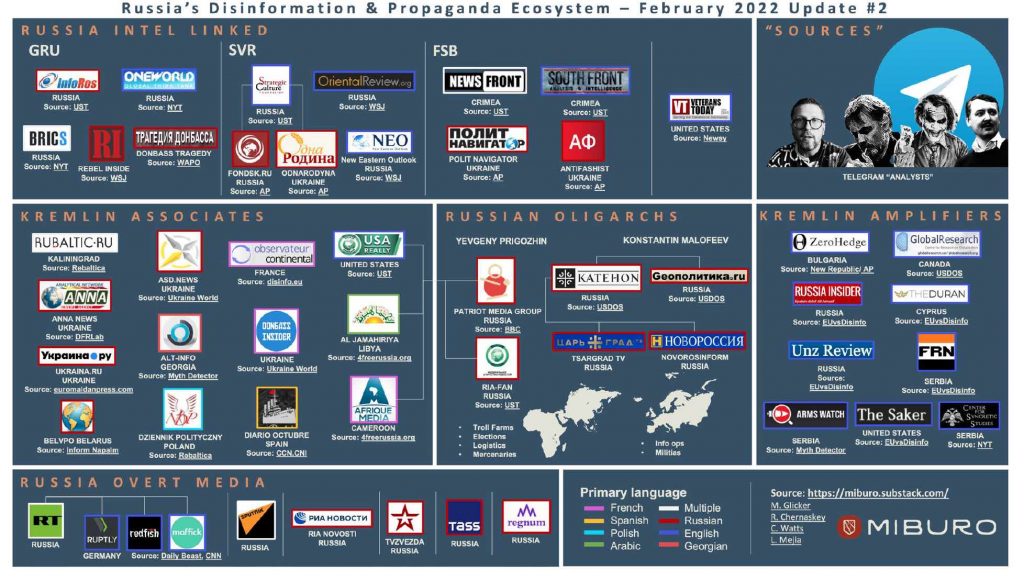

La macchina della disinformazione parte quindi molto spesso dalle fonti istituzionali, rilanciate dai principali organi di informazione generosamente finanziati, come RT (ex Russia Today) e Sputnik, che si autodefiniscono armi dell’informazione. Questa fabbrica di miti, pretesti e accuse è poi ulteriormente amplificata da una rete intricatissima e in continuo aggiornamento di gruppi Telegram, profili anonimi su Twitter, Facebook e TikTok, ma anche influencer e YouTuber come Timofey Sergeytsev, regista di film e filosofo politico russo affiliato al Cremlino; o, John Mark Dougan, l’ex poliziotto statunitense, che ha iniziato a creare contenuti per il canale YouTube iEarlGrey, una piattaforma di propaganda russa gestita, secondo i media russi, dal giornalista indipendente Mike Jones, diventato celebre sul suo canale come streamer di videogiochi.

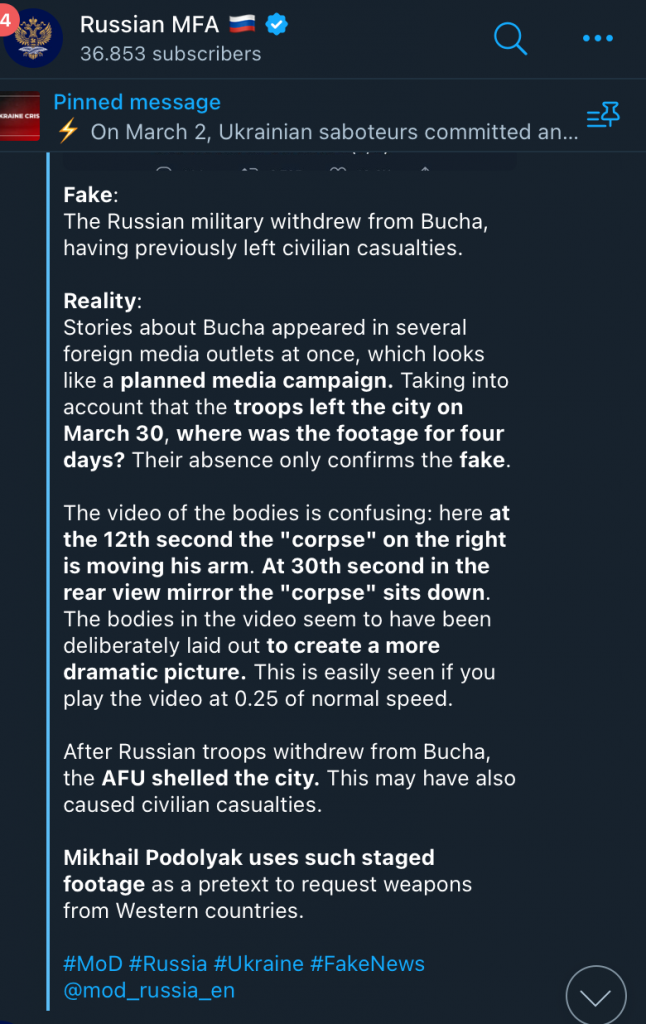

La tipologia di contenuti è spesso caratterizzata dalla presenza di immagini e video che sono manipolabili in modo semplice ed economico. Già a seguito della strage documentata a Bucha nell’aprile 2022 sono iniziate le narrazioni istituzionali tese a screditare il lavoro delle testate occidentali. Lo stesso ministro degli Esteri russo ha dichiarato in un comunicato del 3 aprile 2022 che “nemmeno un singolo residente della zona ha subito alcuna forma di azione violenta”, e ha condiviso su Telegram una versione rallentata di un video che era stato originariamente pubblicato dal canale televisivo ucraino Espreso.tv, accusando di aver allestito video e immagini con corpi disposti come cadaveri per ottenere immagini drammatiche.

Rallentare video sfruttando la compressione dei file condivisi sui social e creando falsi effetti di movimento, così come la ri-contestualizzazione di immagini, sono tecniche che permettono al Cremlino di attaccare fonti internazionali accreditate, distogliere l’attenzione da critiche legittime, sfruttando la disinformazione come arma a proprio vantaggio. Senza contare la censura della stampa russa e le restrizioni che costringono i giornalisti indipendenti a lavorare in esilio, riaprendo studi e testate in città vicine come Riga e trasmettendo i servizi su YouTube.

Il Ruolo dell’Unione Europea

È necessario ricostruire l’ecosistema informativo in cui siamo inseriti, partendo dal livello di alfabetizzazione mediale della cittadinanza europea e da azioni concrete contro la disinformazione.

Uno dei principali obiettivi della conferenza “Oltre la disinformazione” è stato quello di raccogliere il consenso dei principali esperti delle istituzioni dell'UE, degli Stati membri, dei partner internazionali come NATO e Nazioni Unite, ma anche delle organizzazioni della società civile, del mondo accademico e dei giornalisti sul fatto che l'unico modo per combattere questa minaccia è rafforzare le risposte e continuare a collaborare. Quella che Borrell e altri esperti di sicurezza chiamano “resilienza informativa”.

Il rischio che si corre è infatti quello di un attacco diretto alle democrazie europee. La strategia russa di controllo e manipolazione dell’informazione, non è diretta solo verso la sua popolazione, “la Russia ha costruito reti e infrastrutture per ingannare, mentire e destabilizzare, per erodere la fiducia nelle istituzioni” precisa Borrell, mentre il ministro degli Esteri russo Sergey Lavrov è di nuovo in Africa a rafforzare la sinergia economica con il Mali.

Durante il suo discorso, Borrell fa più volte riferimento al livello di professionalizzazione che la Russia ha sviluppato, investendo negli ultimi decenni molte risorse da un punto di vista economico e umano, per diffondere la disinformazione “in modo sistematico, costante e industrializzato - come un’arma”. Il network di siti di informazione e profili social da poche migliaia di follower che vengono continuamente chiusi e riaperti con altri nomi, permettono di lanciare contenuti che poi vengono ricondivisi, amplificando le visualizzazioni e spargendo disinformazione nell’intero ecosistema informativo.

In effetti, secondo la relazione della Alliance for Securing Democracy sui finanziamenti stranieri occulti del 2020, negli ultimi dieci anni la Russia, la Cina e altri regimi autoritari hanno distribuito più di 300 milioni di dollari in 33 paesi per interferire con i processi democratici più di 100 volte, e la metà dei casi riguarda azioni della Russia in Europa.

Non è la prima volta che si sente parlare di “guerra delle narrazioni”. "Non c'è niente di nuovo”, precisa infatti Borrell, “Goebbels l'aveva già inventato durante la Seconda Guerra Mondiale - mentire e diffondere disinformazione non è una novità. Ebbene, ciò che è nuovo oggi è l'intensità, la volontà e gli strumenti. Goebbels non aveva internet, né gli strumenti dei social media”.

Tuttavia, se da un lato, siamo ormai consapevoli delle capacità della rete e dei dispositivi ICT (Information and Communication Technology), è forse più comune associare casi di manipolazione così sistematica e costante a soggetti privati. Facile è l’esempio dell’ex società di consulenza britannica Cambridge Analytica, risultata colpevole per aver influenzato nel 2016 la campagna presidenziale di Trump e il referendum su Brexit, tra le altre. A inizio febbraio è stata anche pubblicata una nuova inchiesta, nata dalla collaborazione di 30 testate giornalistiche coordinate da Forbidden Stories, sul cosiddetto Team Jorge, una società che offre due principali servizi, finalizzati a influenzare elezioni politiche in tutto il mondo: manipolazione automatizzata dell’opinione pubblica, attraverso software proprietari che avviano campagne di disinformazione; e hackeraggio di account di posta e messaggistica privati per generare disordine e confusione tra cariche politiche e funzionari in tutto il mondo.

La strategia europea contro le FIMI

Già dal 2015 la Russia è entrata nel mirino dell'UE che ha creato una task force per tracciare, analizzare e prevedere le campagne di disinformazione avviate dalla Federazione Russa che riguardano l’Unione Europea e gli Stati Membri. Da allora sono stati raccolti oltre 15.000 casi di FIMI: basta accedere alla banca dati EUvsDisinfo per navigare nell’archivio della disinformazione pro-Russia.

Un’attenta analisi, che permette di delineare le caratteristiche e le strategie principali, è stata anche condivisa anche all’interno del Primo rapporto sulle minacce di manipolazione e interferenza delle informazioni estere, la cui pubblicazione ha accompagnato l’intervento di Borrell. Per la stesura di questo report, la task force del SEAE, sotto la divisione Strategia e Comunicazione della Commissione europea, ha preso come casi studio 100 episodi di FIMI avvenuti tra ottobre e dicembre 2022. L’obiettivo della ricerca è quello di partire dalle analisi dei casi studio per definire un framework, identificare dei pattern nelle strategie usate nei casi di FIMI, così da renderli più facilmente riconoscibili e depotenziarli.

Le principali evidenze che emergono da quest’analisi sono:

- Difficilmente gli attori di FIMI collaborano. Su 100 casi, 88 erano prodotti da russi, 17 da attori cinesi e in soli 5 casi entrambi erano coinvolti, almeno in azioni dirette;

- Le operazioni di FIMI sono regolarmente facilitate dai canali diplomatici russi. La prima piattaforma per la condivisione di contenuti è Telegram, sui suoi canali vengono condivise news in più lingue, poi tradotte e ricondivise sugli altri social;

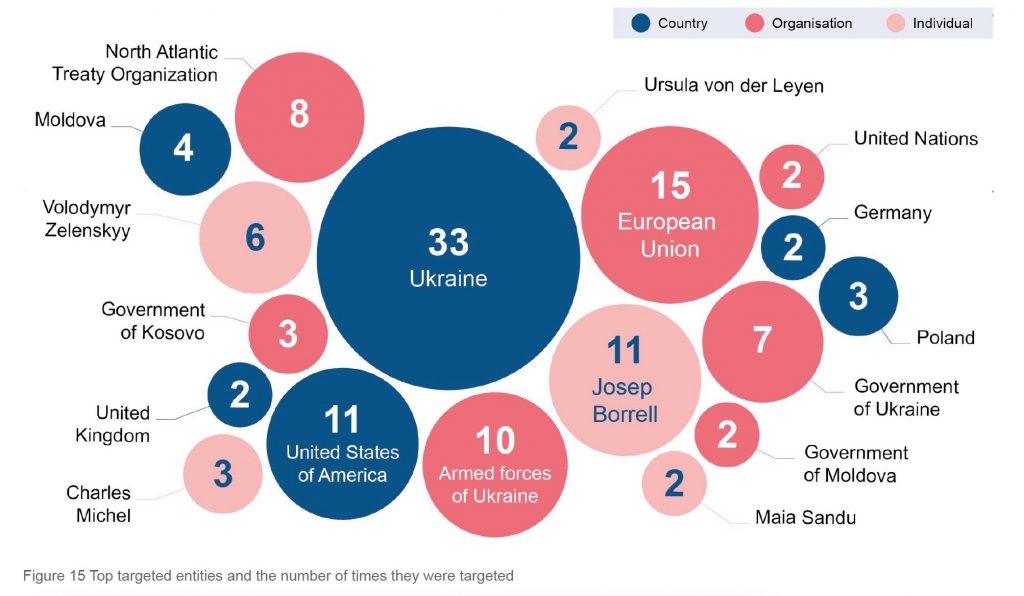

- La propaganda Russa di supporto all’invasione in Ucraina è il tema centrale di 60 su 100 casi. L’Ucraina risulta infatti il paese target di 33 casi, la principale organizzazione l’Unione Europea e la persona fisica l’HR/VP Josep Borrell;

- L’obiettivo principale dei FIMI è quello di distrarre, dirigere l’attenzione verso un diverso attore, tema o causa; secondo obiettivo per gli attori russi è quello di cambiare il framing o la narrazione (35% dei casi), mentre accade solo nel 18% dei casi cinesi;

- I FIMI sono principalmente contenuti basati su immagini e video, sempre più economici, di veloce produzione ed efficaci; utili soprattutto per screditare gli avversari politici e fonti riconosciute come affidabili;

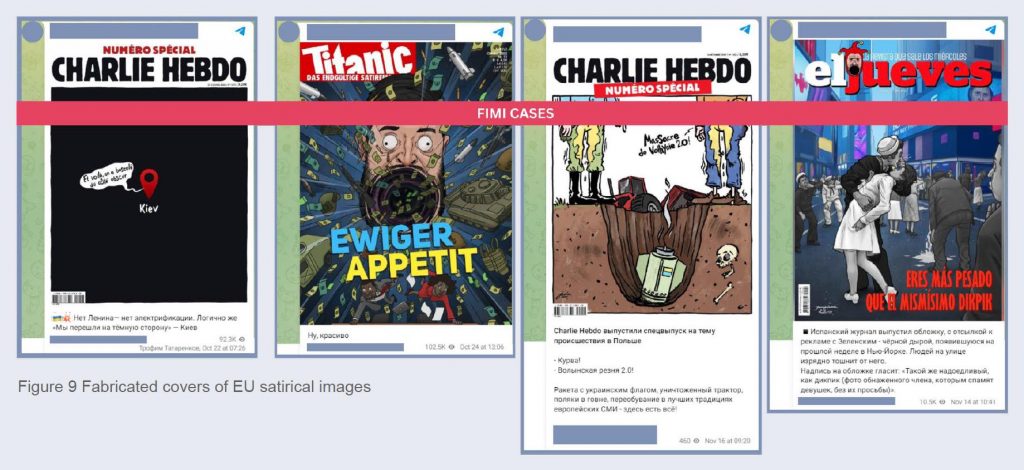

- Una delle principali strategie di disinformazione è quella dell’impersonificazione, ossia di creare copie e falsi profili di organizzazioni personaggi attendibili, ma anche testate giornalistiche, canali TV e riviste.

Attraverso questo report, il SEAE non intende fornire una panoramica completa delle FIMI o del comportamento di un attore specifico. L’obiettivo è piuttosto quello di rispondere alla richiesta del Piano d'azione per la democrazia europea 2020 mostrando l'utilità delle analisi di casi studio per informare le scelte politiche e attivando strategie di gestione della disinformazione.

A seguito della consegna del Rapporto, il Parlamento europeo ha condiviso una proposta di risoluzione, che include il rafforzamento delle task force collaborative su questi temi e la creazione di un framework open source, decentralizzato e interoperabile, che aumenti l'efficienza della condivisione delle informazioni sulle minacce tra i diversi soggetti coinvolti nell'analisi e nella disruption delle FIMI.

Non solo attacco, occorre difendere e prevenire

In particolare, dal rapporto emerge che le strategie proposte dall'UE per affrontare casi di FIMI siano due: una di attacco e l’altra di difesa e prevenzione. La prima, detta “kill chain” tenta di ostacolare i tentativi di FIMI agendo in modo da analizzare, anticipare e interrompere la catena di diffusione di disinformazione. Grazie all’analisi dei casi studio, emerge infatti come la produzione sistematica di questi contenuti riproduca dei meccanismi iterativi, che una volta individuati possono essere disinnescati, evitando che ottengano il loro effetto.

La seconda strategia è invece di difesa, in quanto rivolta ai casi di misinformazione che si verificano ogni volta che a produrre disinformazione sono testate comunemente affidabili o fonti istituzionali, i cui contenuti vengono con molta più probabilità ricondivisi dagli utenti senza cattive intenzioni. Questa strategia, a cui fa appello anche Borrell rivolgendosi agli esperti di (dis)informazione presenti alla conferenza, parte dall’alfabetizzazione ai media digitali, senza fermarsi alle azioni di correzione (fact-checking e debunking), ma iniziando da quelle di prevenzione (prebunking). Non basta infatti mettere in atto pratiche di “pulizia” degli ambienti informativi, è necessario aumentare la consapevolezza con cui le persone condividono contenuti e si informano online.

Allineandosi alle proposte di disseminazione del Centro per la Media Literacy della NATO, quando si parla di educazione ai media è interessante uscire dalla retorica della guerra e dei “nemici” da combattere, per muoversi verso un’osservazione del panorama informativo come un ecosistema.

Questa prospettiva permette di mettere in luce la complessa rete di elementi di cui è composto, i diversi attori responsabili, come nodi di una rete di relazioni: dalle istituzioni alle compagnie private, dai decisori politici ai singoli cittadini, comprese le piattaforme di condivisione dei contenuti e le infrastrutture tecnologiche su cui si appoggiano.

Attraverso questa prospettiva gli esperti di media Whitney Phillips e Ryan M. Milner pongono l’accento sulla natura sistemica che caratterizza gli “information disorder”: è necessario che tutti i nodi che compongono il network dell’ecosistema, grandi e piccoli, siano coinvolti in una ristrutturazione che parte da educazione e consapevolezza delle pratiche informative; che le piattaforme rielaborino i loro modelli di monetizzazione e categorizzazione dei contenuti; che il focus si sposti sull'aspetto collettivo della disinformazione e su azioni diffuse e collaborative per combatterla.

La resilienza informativa in Ucraina

Quello della misinformazione è un disordine informativo molto comune in situazioni di incertezza, lo abbiamo sperimentato tutte e tutti durante l’inizio della pandemia da Covid-19. Quando la situazione è poco chiara e le persone cercano informazioni, facilmente condividono le prime opinioni o notizie che incontrano, anche perché essendo nuove, le notizie non sono (e non possono essere) ancora state verificate. Alimentati dagli algoritmi, che danno più visibilità a contenuti con alto engagement emotivo, spesso post, immagini e video che maggiormente si diffondono in queste situazioni sono i meno affidabili e approfonditi.

Lo conferma anche Valerie Kovtun, giornalista e fondatrice di Filter, la prima organizzazione di alfabetizzazione mediatica sostenuta dal Ministero della cultura e delle politiche dell’informazione del governo ucraino. Mappando le fonti locali affidabili e fornendo corsi gratuiti di media literacy a tutta la cittadinanza, questo progetto si propone di combattere proprio quel grado di misinformazione che è esploso con lo scoppiare della guerra, ma che ha sempre influenzato l’opinione pubblica ucraina.

Nel corso del 2021, Filter è riuscita a costruire una rete di oltre 50 ONG, organizzazioni giornalistiche e istituzioni statali che si occupano di media literacy nel territorio ucraino. Il 23 febbraio 2022 i rappresentanti di cinque Ministeri, delle organizzazioni internazionali e della società civile si erano riuniti intorno a un tavolo per discutere la bozza della strategia quinquennale presentata da Filter.

Al momento dell’invasione, la Russia era convinta di avere anche la “battaglia delle narrazioni” in pugno, ma non aveva contato sulle tante organizzazioni che già stavano tracciando i loro movimenti online. Tra queste, anche il Centro per la Resilienza Informativa aveva già lanciato il progetto Eyes on Russia, una mappa open source per raccogliere, verificare e condividere video, foto, immagini satellitari o altri media relativi all'invasione russa in Ucraina.

Come racconta Kovtun, la strategia di media literacy originaria è stata necessariamente declinata in brevi lezioni che fornissero strumenti pratici per verificare le informazioni in uno stato di overload informativo e incerto come quello caratterizzato dalla guerra. “Da febbraio abbiamo tenuto oltre 120 lezioni e conferenze sulle tattiche di disinformazione in tempo di guerra e abbiamo coinvolto oltre 18 milioni di ucraini attraverso i nostri social media”. La rete creata negli anni ha permesso di diffondere i contenuti e organizzare il primo test nazionale di media literacy: “abbiamo ottenuto risultati fenomenali nonostante le interruzioni di elettricità dovute alla campagna missilistica della Russia. In un solo giorno, il test è stato superato da oltre 17.000 persone”.

Aumentare l’immunità al virus della disinformazione è diventata quindi una necessità politica, oltre che culturale. Non solo nelle scuole di giornalismo o tra gli esperti, bisogna creare percorsi di formazione per capire come funziona l’informazione online, secondo quali logiche si diffondono i contenuti e quali sono le tecnologie con cui possono essere creati. Chiunque deve essere munito degli strumenti utili a prendere decisioni consapevoli e responsabili rispetto alla propria dieta mediatica e alla tipologia di contenuti da condividere o meno negli spazi che abita online.

Immagine in anteprima via wired.it