Moderazione su Facebook: gli utenti potranno appellarsi a una commissione ‘indipendente’ di esperti

8 min letturadi Marco Nurra e Angelo Romano

Una commissione di vigilanza indipendente per giudicare le decisioni prese da Facebook sulla moderazione e rimozione dei contenuti e dei profili. Dopo anni di discussioni sulla legittimità delle proprie decisioni, Facebook ha presentato il regolamento della cosiddetta Oversight Board, una sorta di secondo grado di giudizio, che interverrà su segnalazione o del social network stesso o degli utenti per decidere su quei casi in cui tutti i precedenti livelli di moderazione non avranno trovato una soluzione. La nascente commissione – che sarà operativa il prossimo anno – potrà annullare decisioni prese in precedenza dai moderatori e proporre anche modifiche alle regole di moderazione.

In un post Mark Zuckerberg ha spiegato che la creazione di questo nuovo organismo si è resa necessaria perché Facebook è nato per dare voce alle persone e la libertà di espressione è un valore fondamentale di ogni società democratica che le società private sono chiamate a garantire: “Siamo responsabili dell'applicazione delle nostre politiche ogni giorno e prendiamo milioni di decisioni sui contenuti ogni settimana. Ma alla fine non credo che le aziende private come la nostra debbano prendere da sole così tante decisioni su come le persone si esprimono”. La creazione di una commissione di vigilanza indipendente – ha proseguito Zuckerberg – è un modo per rendere meno opachi e arbitrari i criteri di moderazione: “Se qualcuno non è d'accordo con una decisione che abbiamo preso, può prima fare appello a noi e presto potranno presentare un ulteriore appello a questo consiglio indipendente. La decisione del consiglio sarà vincolante, anche se io o chiunque altro appartenente a Facebook non saremo d'accordo”. In questo modo, ha concluso l’amministratore delegato di Facebook, “speriamo di dare alle persone la certezza che le loro opinioni saranno ascoltate e che Facebook non ha il massimo potere sulla loro libertà di espressione”.

Zuckerberg aveva ventilato l’ipotesi dell’istituzione di una commissione di vigilanza indipendente già un anno e mezzo fa in un'intervista rilasciata a Ezra Klein su Vox. L'amministratore delegato di Facebook aveva detto che stava pensando a «una struttura, quasi come una Corte suprema, composta da persone indipendenti che non lavorano per Facebook, che alla fine danno il giudizio finale su quelli che potrebbero essere i discorsi accettabili in una comunità che riflette le norme sociali e i valori delle persone in tutto il mondo».

Durante l’intervista, Zuckerberg aveva spiegato che era animato dall’obiettivo di dotare il social network di una struttura di governance che rispecchiasse più i desideri degli utenti di Facebook che degli azionisti e di un processo di ricorso indipendente sulle decisioni prese dai moderatori: «Penso che in qualsiasi tipo di sistema democratico ben funzionante debba esserci un modo per fare appello. E penso che possiamo costruirlo internamente come primo passo».

Insieme alla carta che regolamenta questa struttura, Facebook ha presentato anche un documento in cui mostra come ha recepito i suggerimenti giunti dagli esperti contattati in tutto il mondo e un post in cui descrive come funzionerà il processo di governance. Per arrivare alla stesura della carta fondante del nuovo organismo, il social network ha infatti tenuto 6 seminari e 22 tavole rotonde alla quale hanno partecipato giornalisti, esperti di privacy, attivisti per i diritti digitali e costituzionalisti.

Come funzionerà la Oversight Board

Leggendo il Regolamento, alla Commissione di sorveglianza indipendente saranno assegnati 5 poteri fondamentali: il Consiglio “potrà richiedere a Facebook informazioni in tempi rapidi e trasparenti”, “dovrà interpretare gli Standard della Comunità di Facebook e altre politiche interne rilevanti alla luce dei valori complessi che Facebook difende”, potrà dare l'ok al social network sulla cancellazione dei contenuti, ma anche difendere o ribaltare una decisione presa (quindi riabilitare account e post), dovrà emettere tempestive spiegazioni scritte sulle decisioni prese.

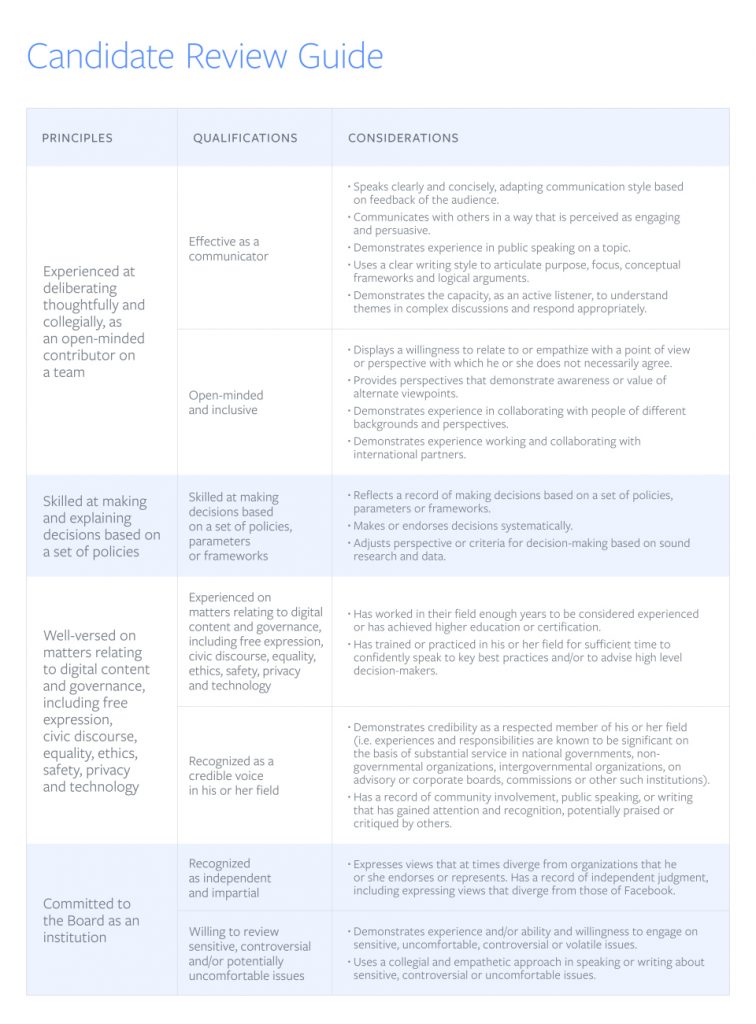

La Commissione sarà composta da 40 membri (inizialmente saranno 11), nominati ogni 3 anni. Ogni incarico sarà rinnovabile al massimo 3 volte. Si tratta di figure “senza conflitti di interessi, reali o percepiti”, “indipendenti e imparziali”, "in grado di deliberare in modo ponderato e collegiale", "abili nel prendere e spiegare decisioni basate su una serie di policy", "esperte di questioni relative alla governance digitale". I 40 membri selezionati non potranno essere rimossi dal loro incarico per le decisioni specifiche da loro prese a meno che non violino il codice di condotta stabilito nel Regolamento.

Facebook nominerà, inoltre, una serie di amministratori fiduciari che dovranno selezionare due co-presidenti della Commissione che avranno il compito a loro volta di istruire e seguire i nuovi membri. L'obiettivo è arrivare a comporre un gruppo che garantisca "un'ampia diversità di rappresentanza geografica, di genere, politica, sociale e religiosa".

Per assicurare indipendenza e imparzialità la Commissione non sarà finanziata direttamente da Facebook ma da un fondo (chiamato Trust) finanziato dall’azienda guidata da Zuckerberg. Il Trust fisserà compensi e rinnovi dei 40 membri.

Il Regolamento specifica anche che le decisioni prese dalla Commissione saranno vincolanti e, quindi, non potranno essere annullate da Facebook tranne nel caso in cui violino la legge o siano tecnicamente impossibili da attuare.

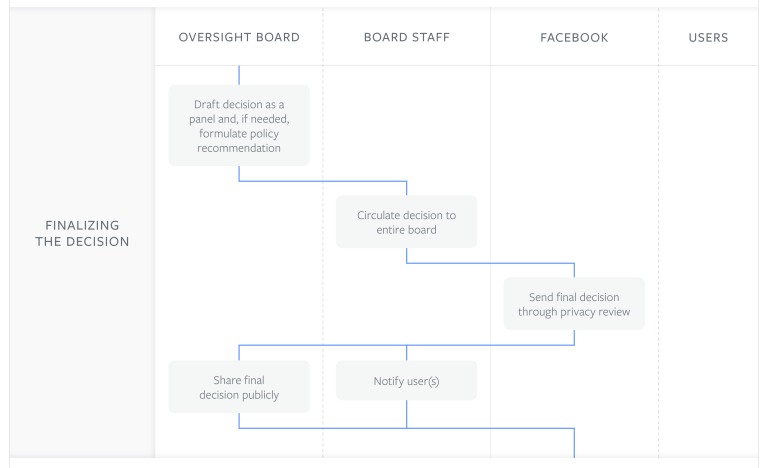

Nello specifico, verranno presi in considerazione quei casi significativi e controversi riguardanti questioni importanti, su larga scala, con un forte impatto sulla vita reale, e nell'interesse di tutti. Ogni singolo caso sarà valutato da 5 membri della Commissione. Il gruppo esprimerà una decisione provvisoria che dovrà ottenere l’approvazione del board completo che potrà validare la valutazione fatta o chiedere una nuova revisione nel caso in cui la maggioranza sarà in disaccordo. Nel suo post Zuckerberg ha aggiunto che nel primo anno la "Commissione valuterà solo un piccolo numero di casi, ma nel tempo speriamo che amplierà il suo campo di applicazione".

Le decisioni saranno rese pubbliche entro due settimane nel rispetto della privacy delle persone coinvolte nel caso e gli utenti interessati verranno informati. Tali decisioni saranno archiviate in un database, destinate a fungere da precedenti per decisioni future.

Il pericolo di semplificare la complessità: l’utopia di un sistema universale di cultura, valori e diritti

In molti si domandano se un organismo di questo tipo, paragonato sin da subito alla Corte suprema degli Stati Uniti d'America, sia una buona idea. Si teme infatti che la mossa di Facebook rappresenti un ulteriore passo avanti verso la privatizzazione della giustizia digitale, l’ennesima delega all’azienda che in questo modo rafforza il suo ruolo di arbitro mondiale della libertà di parola.

D’altra parte, l’idea che la Oversight Board possa funzionare come un tribunale di giustizia che emette la sentenza definitiva su una disputa è una semplificazione pericolosa. Pochi mesi fa, quando la prima bozza del progetto è stata resa pubblica, Issie Lapowsky ha scritto un articolo per Wired nel quale respingeva il parallelismo fatto con la Corte suprema americana, definendolo una minimizzazione dell’estrema complessità che Facebook sta cercando di controllare.

Gli Stati Uniti sono un paese con circa 325 milioni di cittadini, con valori e convinzioni diverse, ma soggetti allo stesso sistema politico e giudiziario e che condividono una base linguistica e culturale. Degli 8.000 casi che vengono presentati alla Corte suprema durante ogni legislatura, ne vengono accolti solamente 80. Torniamo ora al progetto di Facebook: la compagnia suggerisce che una squadra di 40 esperti indipendenti possa controllare le decisioni più problematiche prese in materia di moderazione dei contenuti. L’Oversight Board, scrive Lapowsky, dovrà scegliere non tra migliaia di casi ogni cinque anni, ma probabilmente tra milioni di casi ogni settimana. E le sue decisioni non ricadranno su una popolazione più o meno culturalmente omogenea come quella americana, ma potrebbero avere conseguenze sulla vita online dell’intera popolazione mondiale, più precisamente sui 2 miliardi e 300 milioni di iscritti al social network.

Gli esperti che comporranno questo organismo dovranno quindi prendere delle decisioni a livello globale su questioni molto delicate e sulle quali non esiste un consenso universale: privacy, libertà di parola, linguaggio d’odio, tutela dei minori, razzismo, etc. Quali saranno i valori e i paradigmi costituzionali che guideranno le loro scelte? E questa domanda ci porta verso un altro quesito che per il momento è rimasto disatteso: come sarà rappresentata la diversità all’interno di questo organismo? Dovremo aspettare per vedere quali saranno i risultati della selezione per capire in che misura sarà tenuto in considerazione l’aspetto del pluralismo.

E come giustamente si domanda Josh Constine su TechCrunch: cosa accadrà quando i repubblicani, che per anni hanno accusato Facebook di censurare le loro idee (nonostante i fatti ci dicano il contrario), pretenderanno una maggiore rappresentanza dei conservatori all’interno dell’organismo? Prepariamoci a questo genere di polemiche.

Un organismo “indipendente” che dipende (in parte) da Facebook

La questione relativa all’indipendenza del nuovo organismo è problematica. Quando Zuckerberg annunciò a Vox l’intenzione di creare una sorta di Corte Suprema, Kate Klonick e Thomas Kadri sul New York Times commentarono che l’indipendenza del nuovo organismo era una delle questioni più importanti e al tempo stesso più problematiche da realizzare.

Scrivevano i due studiosi: “La Corte Suprema fa parte di qualcosa di più grande: è il terzo ramo di un sistema che si fonda sulla separazione di poteri. Il Congresso fa le leggi, il tribunale le interpreta e il potere esecutivo le applica. In questo caso, invece, Facebook continuerebbe a svolgere il ruolo sia del Congresso che dell'esecutivo. Ma il ruolo della Corte nella verifica delle azioni congressuali ed esecutive è cruciale e funziona solo perché è indipendente dagli altri rami. I giudici hanno un ampio potere discrezionale nel decidere quali casi ascoltare e sono nominati a vita nel tentativo di proteggerli dalle pressioni della politica esterna”.

Il nuovo consiglio immaginato da Facebook sembra un tentativo di creare questo tipo di organo indipendente, ma affinché non resti niente più che un gesto vuoto dovrà essere indipendente dai suoi ideatori: deve essere finanziato in modo indipendente – “Facebook non può controllare i cordoni della borsa” –, la Corte del social network deve avere ampio potere discrezionale nella scelta dei “casi” da analizzare e deve seguire policy più solide e durature delle regole di moderazione dei contenuti che sono, invece, in continua evoluzione. “Una delle caratteristiche di una costituzione è la sua capacità di essere fedele a dei valori di fronte al cambiamento della società: le costituzioni sono difficili da modificare e da reinterpretare. Qualunque sia la direzione verso la quale soffia il vento, o qualunque sia il suono delle sirene, la costituzione sarà la corda che lega Ulisse all’albero della nave e assicura che l’imbarcazione continui a seguire la sua rotta”.

Gli effetti limitati dei verdetti

Queste novità avranno conseguenze sulla moderazione di Facebook? O si limiteranno ad esprimere giudizi specifici senza però una reale influenza sulle policy? La questione non è per niente scontata.

L’organismo controllore interpreterà la policy di Facebook per decidere se il social network dovrà rimuovere o ripristinare un contenuto per il quale è stato presentato un appello. La decisione verrà presa a maggioranza, cercando il consenso di tutti gli esperti quando è possibile. Facebook sarà obbligato a rispettare la decisione per il contenuto specifico, ma il verdetto non creerà un precedente vincolante per futuri casi analoghi: qualsiasi cambiamento della policy sarà responsabilità unicamente del social network.

Per cui, sebbene le decisioni di questa commissione “indipendente” siano vincolanti caso per caso, sarà Facebook a decidere quale sarà la sua reale influenza nel cambiare le pratiche di moderazione.

Immagine in anteprima via Facebook