Identikit dell’algoritmo di Musk: restare o lasciare X?

|

|

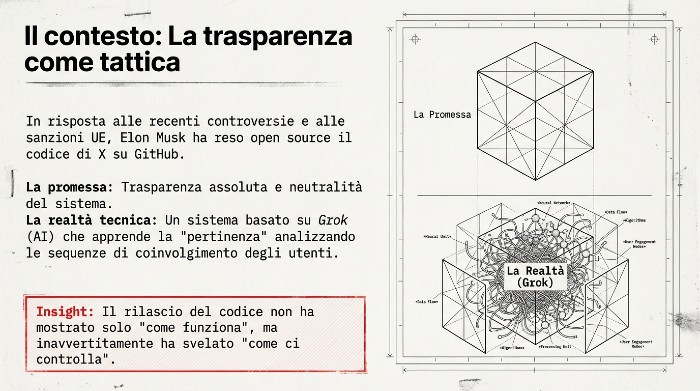

Facendo seguito alle recenti controversie relative al social X, e alla multa inflitta dall’Unione Europea, il miliardario Elon Musk ha reso open source l’algoritmo della piattaforma in un’ottica di trasparenza. In un post su GitHub, X ha fornito un resoconto accessibile sul suo codice di generazione dei feed, insieme a un diagramma del funzionamento del programma. La piattaforma spiega che l’intero sistema è basato sull’intelligenza artificiale, cioè sul trasformatore basato su Grok, per apprendere la pertinenza dalle sequenze di coinvolgimento degli utenti. In altre parole, Grok analizza ciò che l’utente clicca e apprezza e inserisce queste informazioni nel sistema di raccomandazione.

Il codice è, ovviamente, molto lungo e complesso, ma molti, specialmente su X, si sono cimentati nell’analisi. Di seguito ciò che è emerso.

Cosa è emerso dal codice?

Leggendo varie analisi del codice, alcuni elementi appaiono costanti.

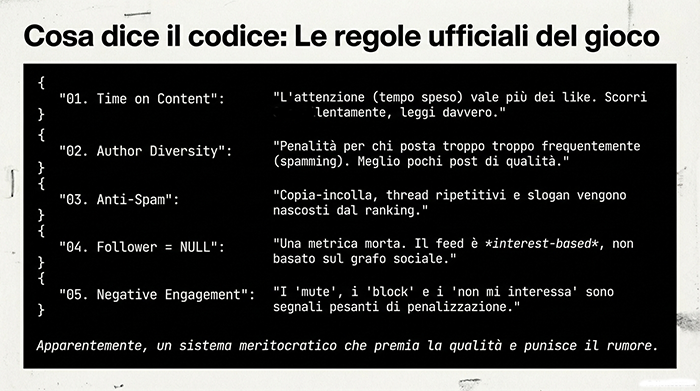

Metrica: time on content

Il tempo che le persone passano su un contenuto conta più dei like. Cioè, non basta mettere un cuoricino, l’algoritmo misura quanto a lungo resti su un post, se quindi lo leggi davvero, se scorri lentamente, se torni indietro. La vera valuta è l’attenzione. I contenuti rapidi ma vuoti perdono rispetto a quelli che trattengono.

Penalità: author diversity

X non vuole che tu legga sempre la stessa persona nello stesso giorno. Se compari sul feed di qualcuno, è meno probabile che tu ricompaia subito dopo (questo è un comportamento che, invece, riscontriamo sui feed di Mastodon). Quindi, pubblicare 10 tweet al giorno non aumenta la visibilità, ma porta a penalizzazione. Meglio pochi post pensati che molti ripetitivi.

Interazione: 128 post

Il feed si basa sugli ultimi 128 post con cui hai interagito. L’algoritmo impara da ciò che leggi, dai like, dai commenti, ma anche da quanto ti soffermi. Se interagisci con contenuti per criticarli, X deduce che ti interessano. In breve, il feed è realizzato algoritmicamente, e questo può portare alla costruzione di una “realtà algoritmica”.

Tossicità: engagement negativo

L’algoritmo non guarda solo quanto interagisci, ma come. Non tutto il coinvolgimento è buono, la visibilità ad ogni costo può ritorcersi contro. Questo sembra contraddire la narrativa “litigare paga sempre”.

Spammer

X combatte gli spammer. I copia-incolla, gli slogan reiterati, i thread fotocopia, sono elementi che abbassano il ranking. L’algoritmo quindi ragiona in termini di comportamento, non solo di contenuto.

Follower

I follower non contano, non garantiscono visibilità. È sostanzialmente una metrica morta, anche perché molti follower sono inattivi. Il feed è interamente interest-based. Quindi, anche un account piccolo può “esplodere”. In sintesi, conta quanto valore percepito genera ogni singolo post, non la platea potenziale.

Ranking e engagement

Se attiri l’attenzione ma fai scappare le persone, perdi. L’algoritmo premia ciò che trattiene senza respingere, non cerca solo rumore, ma stabilità. Quindi i like, i commenti, i retweet sono punti positivi, me i mute, i block, i “non mi interessa” sono punti negativi.

Reply guy

X è uno spazio conversazionale. Rispondere bene ti rende visibile, è costruzione di reputazione semantica. Per un account piccolo, quindi, è più efficace commentare bene che postare nel vuoto. Non “reply” a caso, ma aggiungere senso. X appare, quindi, più come una piazza che come un palco.

Gaming the system

Non forzare il sistema. Questa è la regola forse più importante. Non devi provocare apposta, inseguire trend senza senso, costruire engagement falso. Per cui conviene essere autentici (o almeno apparire tali), più che essere aggressivi e manipolativi. Insomma, X premia interazioni che non violano il suo sistema.

In estrema sintesi, l’algoritmo distingue attenzione sterile da attenzione fertile. La conversazione è premiata rispetto allo scontro, la qualità relazionale è una variabile rilevante. Il segreto sta nel creare contenuti che generano conversazione reale, più che creare engagement.

Come leggere queste analisi?

Fin qui una sintesi ragionata delle analisi pubblicate proprio su X della lettura del lungo e complesso codice di X. Ovviamente non siamo in grado di confutare queste affermazioni, ma la lettura delle stesse fa emergere che siano meno neutre di quanto vogliono far credere. Ci sono molte cose che non tornano, anche semplicemente comparando queste analisi all’esperienza quotidiana. Non torna la pretesa di neutralità, la moralizzazione del controllo, la confusione tra conversazione e tensione, la trasformazione dell’attenzione in valore etico. Proviamo a ricostruire il tutto sotto una diversa lente, premettendo fin da subito che si tratta di una lettura parziale e, sotto molti aspetti, soggettiva.

I testi suggeriscono che X premi il buon comportamento e punisca la tossicità. Cioè, preferisce conversazioni sane. Ma X non è un arbitro morale, bensì un’azienda che monetizza attenzione. Se la tossicità funziona (e spesso funziona), non viene eliminata, ma incanalata e gerarchizzata. Ciò che cerca l’algoritmo non è la bontà del contenuto, ma quanto trattiene gli utenti, senza però andare contro le regole dell’algoritmo stesso.

La regola “don’t game the system”, ad esempio, appare un'evidente contraddizione logica. Stiamo parlando di un algoritmo con una serie di regole operative, che promette “successo”. Le analisi pubblicate su X sono esse stesse, quindi, dei piccoli manuali per gamificare il sistema, solo tradotte in una forma etica. Tutte o quasi dicono: “non manipolare l’algoritmo, ma ti spiego come manipolarlo bene”.

Continuando, X non premia la conversazione in quanto tale, ma premia le conversazioni polarizzanti ma non terminali, quelle che non chiudono la discussione. Premia i conflitti che durano, gli attriti senza risoluzione. Una conversazione che chiarisce, che chiude un tema, che riduce il conflitto, è meno redditizia di una che lo mantiene vivo. Quando si dice che “X è costruito sulla conversazione” si intende che è studiato per mantenere viva la conversazione, non per farla terminare.

I follower non contano? Sì e no. Sicuramente contano molto meno di prima, ma conta moltissimo chi sono, quanto sono attivi e che reputazione semantica hanno. Su X c’è una distinzione, gli account grandi hanno più diritto all’errore e subiscono meno penalizzazioni immediate. “I follower non contano” appare una sorta di mezza verità consolatoria, utile a vendere l’idea di meritocrazia algoritmica.

Riguardo la tossicità, c’è un’evidente frattura tra le analisi pubblicate su X e l’esperienza empirica quotidiana. Se la tossicità fosse davvero penalizzata, certi account non avrebbero visibilità e certe dinamiche non sarebbero sistemiche. Nella realtà ciò che appare è che la tossicità è premiata se moderata, e soprattutto appare tollerata la tossicità asimmetrica, cioè quella verso gruppi più deboli. Inoltre, la tossicità politicamente utile appare spesso amplificata. Non è un algoritmo anti-tossicità, ma un algoritmo che gestisce e gerarchizza la tossicità.

La narrativa descrive un algoritmo attento al contenuto e al tempo speso. Ma il tempo speso non distingue attenzione consapevole da dipendenza, compulsione o rabbia. L’algoritmo non sa se stai capendo o odiando.

Un punto essenziale che le analisi del codice non considerano affatto è il “padrone” della piattaforma. I racconti descrivono un algoritmo neutro, uguale per tutti. Nella realtà appare evidente che il padrone della piattaforma posta, amplifica, risponde, cambia le regole in corsa, e decide ciò che è tossico. Non è un algoritmo neutro, ma un algoritmo con un preciso guinzaglio, spesso strumentale.

Quindi, appare evidente che le analisi tecniche del codice di X, pubblicate su X, sono più che altro interpretazioni normative travestite da analisi, in coerenza col funzionamento algoritmico della piattaforma. Le analisi descrivono come dovresti comportarti per essere accettabile su X. In breve sono norme sociali mascherate da consiglio tecnico. Quello che emerge è più che altro un algoritmo che educa la società, premiando alcune forme di espressione e rendendone altre invisibili.

Come funziona l’algoritmo di X?

Proviamo, quindi, a riscrivere queste analisi in maniera un po’ più onesta, tenendo in considerazione però ciò che vediamo davvero stando su X. Proviamo a capire come funziona il campo di gioco. Non c’è alcune intenzione di “dimostrare”, ma l’idea è di mostrare una coerenza sistemica, pur consci che si chiede al lettore una certa fiducia interpretativa.

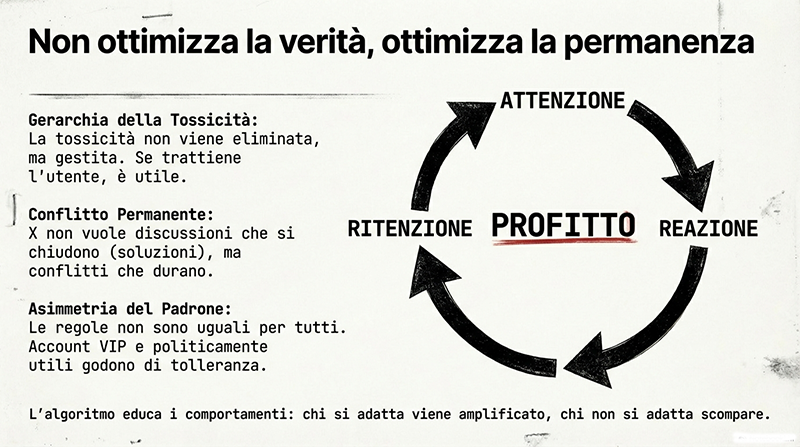

Iniziamo. X non premia il contenuto, ma l’attenzione sostenuta. X misura quanto tempo resti, quanto spesso torni, quanto intensamente reagisci. Non distingue tra interesse, rabbia, indignazione o dipendenza. Se un contenuto ti trattiene, allora funziona, il resto non conta.

La tossicità non è un bug da espungere, ma una risorsa da gestire. X la modula, la distribuisce, la usa fintanto ché non viola le sue stesse regole. La tossicità genera thread lunghi, crea fazioni, fidelizza identità antagoniste. Viene penalizzata solo quando diventa ingestibile.

Le regole non sono uguali per tutti. Gli account più grandi, quelli politicamente utili, quelli vicini al “potere” della piattaforma, hanno più visibilità e più tolleranza. Musk non è un’eccezione, ma la prova che il sistema ha un padrone al quale risponde.

Il feed non mostra ciò che ti piace, ma ciò che ti aggancia. Non ottimizza verità né qualità, piuttosto la probabilità che resti, che reagisca, che torni domani. Spesso questo implica contenuti estremi, narrazioni semplificate e conflitti ripetuti.

La conversazione non è il fine, ma il mezzo. X non premia il dialogo che chiude o pacifica, ma vuole un dialogo che continua. Le migliori conversazioni sono quelle cicliche, polarizzate e senza esito. X premia il disaccordo stabile.

I follower contano poco, ma conta molto il potere relazionale, la posizione nella rete, la reputazione semantica, l’accesso a cluster influenti. È una struttura di potere dinamica.

Ogni interazione conta, anche quelle negative, come i mute e i block. Sono segnali che l’algoritmo gestisce.

In estrema sintesi, l’algoritmo educa i comportamenti. Col tempo insegna agli utenti come scrivere, come provocare, quanto estremizzare e quando fermarsi. Chi si adatta viene amplificato, chi non si adatta scompare. Il sistema non punisce l’essere un “jerk”, ma l’essere inefficiente. Puoi essere aggressivo, disinformante, o manipolativo, basta che tu riesca a mantenere alta l’attenzione. In estrema sintesi ciò che interessa a X non è che tu capisca, ma che tu resti.

Che tipo di soggetti produce un ambiente di questo tipo?

Proviamo a redigere un breve e non esaustivo elenco antropologico minimo degli utenti di X per come l’algoritmo prova a ristrutturarli.

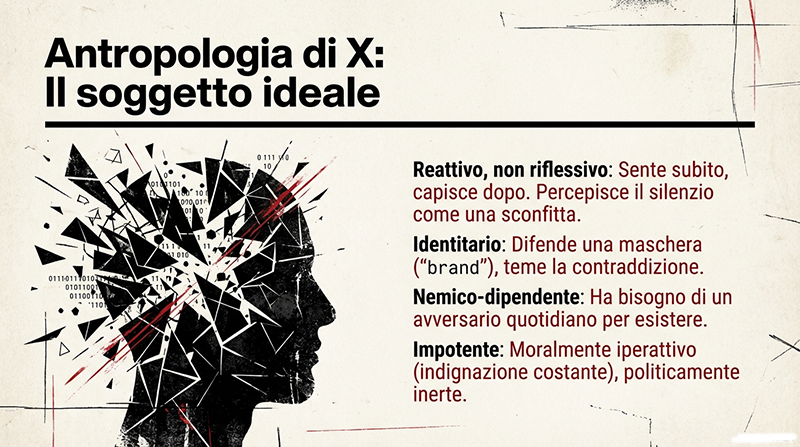

Il soggetto ideale è quello reattivo (non rilessivo), uno che reagisce subito e prende posizione, uno che semplifica, uno che sente più che capire e che percepisce il silenzio come perdita. La riflessione che fa capire è lenta, quindi inutile.

Su X non hai un’opinione, piuttosto la incarni. L’algoritmo favorisce la coerenza ideologica rigida, la riconoscibilità. Questo produce soggetti che difendono una maschera, un’identità, piuttosto che un’idea. Soggetti che temono la contraddizione, perché viola l’identità, e vivono il cambiamento come rischio reputazionale.

X non vuole soggetti isolati, ma in relazione. Puoi essere “estremo” ma non da solo. X produce soggetti che odiano l’altro campo, ma ne hanno bisogno per esistere, e quindi tornano costantemente allo stesso identico conflitto. Soggetti che hanno bisogno di un nemico quotidiano.

Un soggetto a cui tende l’algoritmo di X è il soggetto moralmente iperattivo e politicamente impotente. Su X giudicare è facile, ma agire è raro. Il sistema incentiva l’indignazione costante, ma scoraggia l’organizzazione e la costruzione lenta. Il soggetto che cerca di costruire qualcosa è punito.

Su X il soggetto è educato algoritmicamente. Col tempo impara quali parole funzionano, quale tono viene premiato, e quanto essere estremo. L’adattamento è spontaneo, è un prodotto dello stesso sistema che poi lo giudica. Si tratta di un soggetto che vive in un eterno presente, che fatica a costruire una memoria degli eventi e ricicla gli argomenti. Un soggetto che scambia visibilità per verità e quindi si percepisce importante e reale perché è molto condiviso e discusso. Un soggetto che impara a autocensurarsi strategicamente ed evitare ciò che non rende.

Anche per questo molte persone, stanche di X, fanno fatica ad uscirne. Perché X produce dipendenza conflittuale e identità pubblica legata al feed.

Che forma assume la democrazia quando i soggetti sono di questo tipo?

I soggetti prodotti dall’algoritmo di X sono soggetti che sanno votare, che firmano petizioni, esprimono preferenze e reagiscono ad eventi. Ma faticano a deliberare, a sostenere conflitti lunghi, ad accettare compromessi, a mantenere una memoria storica. Una democrazia retta da individui simili è procedurale (elezioni, sondaggi, maggioranze), non sostanziale. Una democrazia che funziona ma non decide davvero, che non riesce più a costruire senso comune.

Il soggetto prodotto dall’algoritmo è iper-sensibile, rapidamente mobilitabile, e altrettanto rapidamente esauribile. Questo produce picchi di partecipazione e ondate di indignazione, ma rapide dimenticanze. La politica diventa gestione di flussi emotivi, non governo delle risorse e soluzione dei problemi comuni.

La deliberazione richiede ascolto e lentezza. Ma anche capacità di cambiare idea senza stigma e di scendere a compromessi. L’algoritmo produce, invece, esposizione continua, punizione del cambiamento. Il risultato sono posizioni rigide e identitarie, e quindi una politica immobile.

Ma è importante tenere a mente che l’algoritmo non produce una democrazia caotica, bensì una democrazia stabile, perché rigidamente polarizzata. Una democrazia che ha due o più campi con confini chiari, identità forti e un conflitto permanente. Una democrazia instabile nel discorso, inadatta al dialogo, ma stabile nella struttura.

Il potere decisionale, in un quadro del genere, appare facilmente spostabile dallo Stato al mercato e alle infrastrutture. È l’ideale per piattaforme monopolistiche e media partigiani. La democrazia resta formale, ma il potere decisionale finisce altrove e diventa opaco.

In tale situazione la partecipazione è simbolica, sconfina nella visibilità, nell’apparire impegnati più che efficaci. L’atto politico diventa performance morale, non più gestione delle risorse comuni.

La democrazia, infine, poiché i soggetti prodotti dall’algoritmo vedono una realtà frammentata in troppe versioni, perde fiducia. “Sono tutti uguali”, “tanto non cambia nulla”. La democrazia produce cinismo e sopravvive senza legittimità emotiva. Non è dittatura, è sempre democrazia, stabile, ma conflittuale, senza speranza di cambiamento, arroccata sulle proprie posizioni inconciliabili, una post-democrazia senza demos.

Resistere senza uscire?

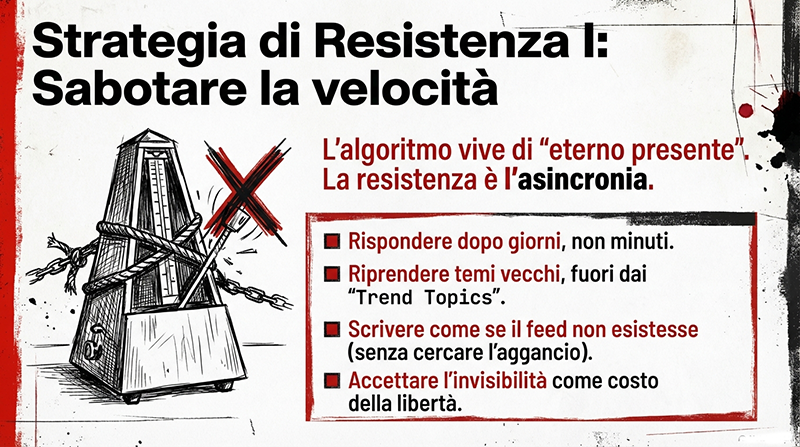

Chiariamo immediatamente: resistere senza uscire non significa battere l’algoritmo, piuttosto sottrarsi alla sua pedagogia pur restando nell’infrastruttura.

Proviamo a capire. Ovviamente non può esistere una resistenza spettacolare che diventa stile o brand. Un uso etico di X o “faccio commenti profondi e l’algoritmo mi premierà” non è ipotizzabile. L’algoritmo non vuole questo e, prima o poi, ti penalizza. Resistere significa più che altro cambiare il rapporto col tempo. L’algoritmo vive di urgenza, in un presente eterno. La prima forma di resistenza, quindi, è introdurre asincronia. Ad esempio, rispondere dopo ore o giorni, riprendere temi fuori trend, scrivere come se il feed non esistesse. Rallentare, però accettando l’invisibilità.

Se l’indignazione è il carburante dell’algoritmo, un'altra forma di resistenza è sottrarsi all’indignazione. Non commentare tutto, non rispondere alle provocazioni, lasciare morire i thread che vogliono inglobarti.

Bisogna imparare a usare X come strumento non come ambiente. Attraversarlo senza abitarlo, entrare con uno scopo preciso, non scrollare senza intenzione.

Resistere vuol dire anche accettare l’ambiguità, e scrivere per pochi, perché l’algoritmo premia la massima leggibilità e quindi la semplificazione. Non spiegare tutto, non semplificare.

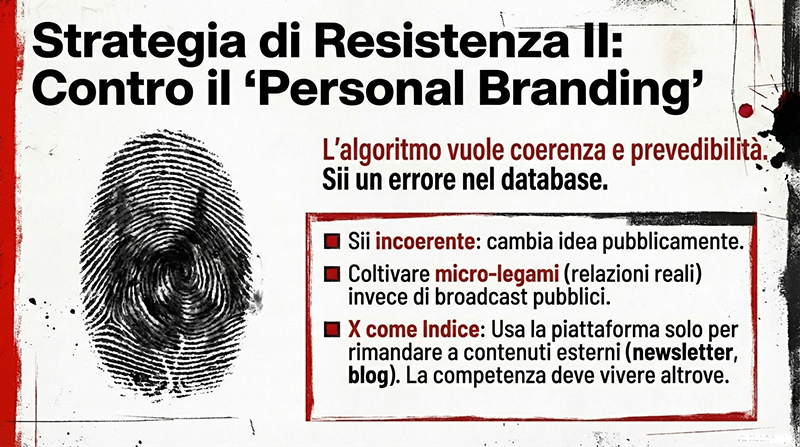

L’algoritmo premia le relazioni performative, e gli scontri pubblici. Resistere vuol dire coltivare micro-legami, una continuità silenziosa. Il tessuto democratico nasce fuori dal feed.

Punto centrale della resistenza è non accettare l’idea di identità come brand. Il soggetto di X è riconoscibile, prevedibile e quindi categorizzabile. Resistere vuol dire non costruire un’identità coerente, cambiare idea, non chiarire “da che parte stai”.

Resistere significa anche, e soprattutto, fare della competenza un luogo e non un contenuto. Se l’algoritmo trasforma tutto in contenuto, resistere vuol dire usare X per rimandare altrove, rimandare a testi lunghi e complessi, non semplificati, a conversazioni lente e spazi non metricizzati. Usare X come un indice.

Ovviamente, il prezzo è accettare la perdita di visibilità. Non puoi resistere e rimanere visibile. Non aspettarti premi o giustizia algoritmica. Resistenza è usare X, non farsi usare da X.

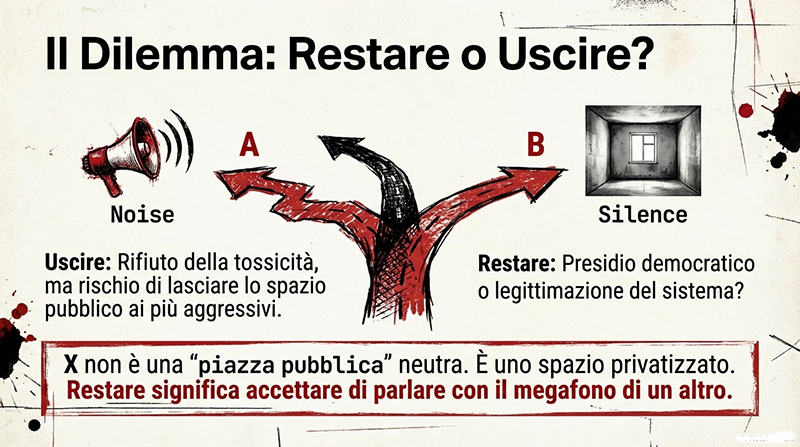

Conviene restare o uscire?

Questa domanda è ormai onnipresente. Premetto che rispetto le scelte di ognuno, e capisco le motivazioni. Quelle di seguito sono solo le mie riflessioni in tema.

Andarsene non è neutralità, ma è una scelta politica. Chi esce spesso lo fa per rifiuto della tossicità, rigetto della manipolazione. Ma l’effetto sistemico non è lo svuotamento dello spazio pubblico, bensì il cambiamento della sua composizione. Rimangono i più aggressivi, i più adattivi all’algoritmo, i più cinici e i più ideologicamente rigidi. L’uscita peggiora l’ecosistema, non perché sbaglia chi va via, ma perché la piattaforma penalizza il vuoto qualitativo.

Ma bisogna essere onesti, restare non diventa automaticamente una virtù civica. Restare significa legittimare l’infrastruttura, alimentare metriche, normalizzare il potere del “padrone” della piattaforma. Molto “restare” non è resistenza ma adattamento travestito da impegno. C’è differenza tra restare “presidiando” e restare “abitando”.

Il punto essenziale, da non perdere mai di vista, è che X non è più lo spazio pubblico classico. Non è neutro, non è comune, non è democratico. È uno spazio pubblico privatizzato con regole opache, e asimmetrie strutturali. Questo è lo spazio che presidiamo se restiamo.

Possiamo credere che difendiamo qualcosa, che bilanciamo la tossicità, ma in realtà l’effetto è come restare muti in una piazza dove un altro ha il megafono.

D’altro canto, non si può fare a meno di pensare che, se tutti quelli che riflettono, argomentano e mantengono la complessità, si ritirano in newsletter e spazi chiusi, la sfera pubblica si impoverisce, il dibattito si tribalizza e la complessità diventa appannaggio delle élite. Diventa una democrazia a doppio strato, rumore sopra e complessità sotto, nascosta, che non si incontrano più.

Qual è la posizione eticamente sostenibile? Restare abbastanza per non cedere spazio? Uscire abbastanza da non essere “educati” dall’algoritmo? Non per vincere ma per non abbandonare lo spazio pubblico?

Ognuno avrà la sua risposta, ma forse il vero pericolo sta nel confondere X con lo spazio pubblico. Lo spazio pubblico, oggi, è distribuito e fragile, disallineato e in competizione. X è solo uno dei luoghi. L’importante è, per chi resta, non restare solo lì, perché così perdiamo tutto il resto. L’importante è tenere aperti più spazi senza sacralizzarne nessuno.

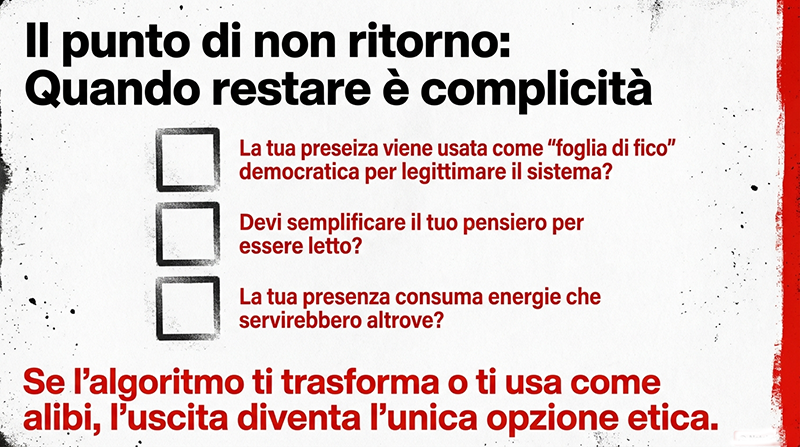

Quando restare è complicità?

A un certo punto, però, restare non è più testimonianza, ma può diventare complicità. Finché restare diventa disturbare, rendere visibile una frattura, non normalizzare, la presenza può avere un senso etico. Ma se la tua presenza viene usata come prova che il sistema funziona, se diventi l’alibi pluralista, la foglia di fico democratica, la complessità tollerata per certificare apertura, forse restare è più un danno perché non opponi più resistenza, ma certifichi legittimità.

Se per restare devi semplificare sistematicamente, devi irrigidire il tuo linguaggio, devi performare identità, quando ti accorgi che pensi in funzione dell’algoritmo, allora stai diventando qualcuno che non eri.

Quando restare produce cinismo, rabbia, esaurimento, perdita di fiducia generalizzata, impoverimento del pensiero, non stai più difendendo il fronte, ma bruciano risorse umane.

Quando il dissenso viene sistematicamente invisibilizzato, quando la moderazione è selettiva, quando il “padrone” interviene direttamente ad imporre la sua volontà, quando le regole mutano nel corso degli eventi, quando la piattaforma diventa strutturalmente incompatibile col vero dissenso, non sei più nella piazza pubblica.

Ma, soprattutto, quando il tuo restare assorbe tutte le energie, consuma tutto il tempo, ritarda investimenti altrove, quando il tuo restare impedisce la costruzione di alternative, allora l’uscita diventa un imperativo. Uscire non è tacere, sparire, smettere di parlare, significa spostare il luogo della discussione, sottrarre attenzione, ricostruire altrove.

Ovviamente, non esiste una risposta valida per tutti, e non esiste una risposta valida per sempre. L’etica qui è situata e temporale, reversibile. Può essere giusto uscire oggi ma tornare domani, rimanere in forma minima, oppure andarsene per sempre. L’unica cosa che è certamente sbagliata è rimanere per inerzia.

Chi è il mostro?

Monstrum, nel senso di ciò che “mostra”, che evoca una frattura, un limite, un confine, è il prodotto del sistema, non più l’eccezione.Il “mostro” non è il “padrone” dell’algoritmo, non è l’algoritmo, e non è nemmeno la piattaforma. Questo sarebbe rassicurante, perché localizza il male fuori da noi. Ma quello è solo il livello del potere, non la mostruosità.

In Frankenstein il mostro è creato dalla società, viene rifiutato, e, dopo l’esclusione, diventa violento. Su X, invece, il mostro viene premiato, non escluso, non è l’anomalia, ma il comportamento meglio adattato. Il mostro oggi non è chi trasgredisce le regole, ma chi le interiorizza perfettamente, chi ottimizza il linguaggio, massima l’attenzione e performa l’indignazione. È umano, riconoscibile, plausibile, ed è questo che fa paura.

Il soggetto più pericoloso non è il troll urlante, il fanatico, bensì l’utente medio che si adatta alle regole, perché “è così che va”. È la normalizzazione della deformazione. È chi dice cose che non farebbe, che performa identità che non gli appartengono, è tecnicamente efficiente ma eticamente disallineato. Il mostro non è l’ibrido uomo+macchina, ma l’ibrido uomo+algoritmo.

Il vero pericolo è che il mostro non è individuabile, perché è distribuito, sistemico, quotidiano. Ogni giorno partecipa ad una shit-storm, perché “tanto è così”, condivide qualcosa di semplificato, resta per inerzia, confonde visibilità con verità.

Il mostro, però, è premiato moralmente, è celebrato come bravo comunicatore, è l’esperto che ti dice che tutto va bene e tu devi adattarti alla realtà, è il modello additato ai più. Il mostro non segnala più un confine, lo sposta.

Il “monstrum” è l’essere umano che funziona troppo bene in un sistema che non dovrebbe funzionare così. Ed è per questo che fa paura: perché non è altro da noi. Ma è una possibilità normale.

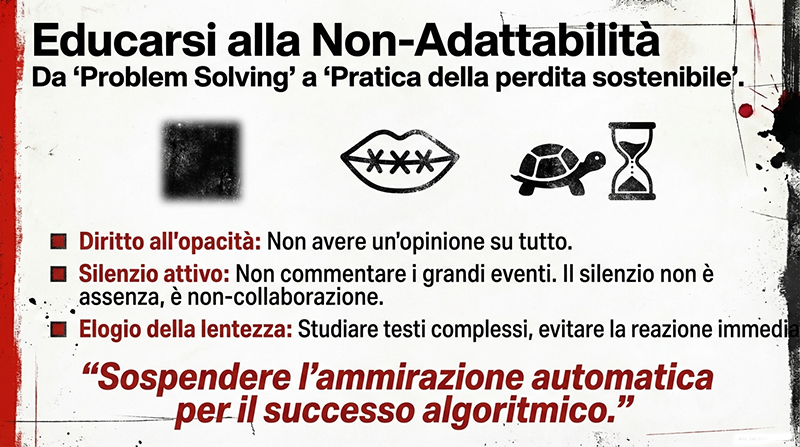

Come educarsi alla non-adattabilità?

L’educazione dominante insegna efficacia, ottimizzazione e problem solving. Come evitare di adattarsi ad un sistema che premia le deformazioni? Non vogliamo realizzare certo una contro-pedagogia, ma alcuni suggerimenti possono tornare utili.

Prima di tutto occorre distinguere tra funzionare e valere. Ad esempio, sospendere l’ammirazione automatica per il successo. Alcune piattaforme sono piene di riverenti ed ossequiosi adattamenti al successo altrui.

Il soggetto adattato vive nel presente continuo. Per rompere questo incantesimo occorre adattarsi a testi lunghi, a uno studio lento, al ritorno sugli stessi temi a distanza di tempo, per rivederli e rinfrescarli, senza timore di ammettere errori. Insomma, imparare a non reagire.

L’educazione classica prepara al successo. La non-adattabilità richiede pratica di perdita sostenibile. Ad esempio, fare cose sapendo che non verranno viste, difendere una posizione impopolare senza teatralizzarla, accettare di non essere premiati.

L’algoritmo richiede chiarezza, identità e posizionamento costante. La non-adattabilità è il diritto a non dire tutto, a non avere un’opinione pronta, a prendersi il tempo per pensare, a sospendere il giudizio pubblico. L’opacità non è menzogna, ma difesa cognitiva.

L’algoritmo pretende velocità e presenza. Per l’algoritmo il silenzio è un atto di assenza e disimpegno, quasi codardia. Una contro-educazione vede il silenzio come gesto attivo, quindi non commentare eventi iper-mediatizzati, casomai scriverne a distanza di tempo, sottrarsi ai cicli di indignazione, distinguere ciò che richiede presenza e ciò che richiede distanza. Il silenzio non è vuoto, ma non-collaborazione.

L’algoritmo pretende un’opinione su tutto, e una presenza continua. La non-adattabilità, invece, stabilisce confini, accetta l’incompletezza, rinuncia all’onniscienza performativa. Si può anche dire “non lo so” e riconoscere ambiti di incompetenza, smettere di essere aggiornati su tutto.

Infine, l’algoritmo cattura ogni discorso inglobandolo. La contro-educazione si occupa di creare contesti e curare luoghi, gruppi di studio, seminari, comunità di senso. La democrazia sopravvive nei luoghi, non nei feed.

Ma , sia chiaro, il protagonista della non-adattabilità non è un eroe o un ribelle da cinema, piuttosto un inadatto consapevole, uno che sceglie di non adattarsi e soprattutto riconosce quando l’adattamento diventa deformazione.

Immagine in anteprima: Gemini (Nano Banana Pro)