Facebook rimuove articoli sul coronavirus per errore: è un bug nel sistema anti-spam

3 min letturaLunedì scorso, Google, Facebook e Twitter hanno avvisato che molti contenuti potrebbero essere rimossi erroneamente nei prossimi giorni a causa di apparenti violazioni della policy. Questo problema è dovuto al fatto che i social network stanno mandando a casa molti dei loro moderatori, in seguito alle misure sanitarie di sicurezza per mitigare la propagazione del Covid-19, e quindi dovranno affidarsi maggiormente ai sistemi di rimozione controllati dall’intelligenza artificiale (AI).

Leggi anche >> Tutti i nostri articoli sul coronavirus

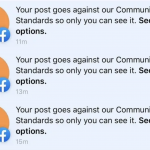

I primi inconvenienti non hanno tardato a manifestarsi. Martedì molti utenti hanno segnalato su Twitter che alcuni articoli sull’emergenza sanitaria erano stati rimossi, nonostante si trattasse di fonti affidabili. Questo errore, imputabile all’intelligenza artificiale che regola la moderazione sulla piattaforma, è stato sicuramente aggravato dall'assenza di un sufficiente controllo umano.

So, @Facebook has removed a link I posted to an @AP story about the role of service journalism in ensuring public access to reliable information during #COVID19 due to “spam” rules. Here’s the allegedly objectionable link: https://t.co/zARpPc3neU #Disinfo agents in action? pic.twitter.com/6hYx7YNqqn

— Dr. Julie Posetti (@julieposetti) March 18, 2020

Alcuni hanno gridato alla censura, altri hanno temuto che potesse essere una nuova policy, molti ancora oggi non sanno come funziona la moderazione sui social. Alex Stamos, ex responsabile della sicurezza di Facebook, ha ipotizzato da subito che potesse trattarsi di un filtro anti-spam. “Facebook ha mandato a casa molti moderatori di contenuti ieri, che generalmente non possono lavorare da casa per via delle clausole di privacy stipulate con la compagnia. Probabilmente stiamo assistendo all’AI che, senza il controllo umano, inizia a impazzire”, ha twittato.

Poco dopo, Facebook ha confermato ufficialmente che il filtro anti-spam del social network ha bloccato numerosi post, articoli e altri contenuti sul coronavirus a causa di un bug. La compagnia ha ammesso l’errore e ha assicurato che non si tratta di una nuova policy nella moderazione dei contenuti, ma di un inconveniente legato ai loro sistemi automatici di moderazione.

We're on this - this is a bug in an anti-spam system, unrelated to any changes in our content moderator workforce. We're in the process of fixing and bringing all these posts back. More soon.

— Guy Rosen (@guyro) March 17, 2020

Nonostante Facebook abbia ammesso l’errore, questo episodio deve farci riflettere sull’effimera efficacia dell'automazione quando parliamo di moderazione dei contenuti.

Su Valigia Blu abbiamo parlato più volte del rischio che i filtri anti-spam possano derivare in una sorta di censura preventiva. In questo caso, non si tratta di vera e propria censura, quanto più che altro dell'ennesima prova dell'inadeguatezza dell’AI per moderare la conversazione online.

Ricordandoci che problemi come questo sono la diretta conseguenza di ciò che in molti, negli ultimi anni, hanno preteso da Facebook: avere la responsabilità di quello che pubblicano gli utenti, essere il giudice dei nostri contenuti e delle nostre conversazioni.

Perché i moderatori non possono lavorare da casa

Il giornalista tecnologico Casey Newton, che ha analizzato i problemi legati alla moderazione sui social in diversi articoli pubblicati su Verge, è tornato sull’argomento per spiegare come mai il lavoro di moderazione non può essere svolto da casa. Una questione che era stata anticipata anche da The Intercept la settimana scorsa.

Attualmente le compagnie tecnologiche hanno l'obbligo di rimuovere la propaganda terrorista, le immagini di abuso infantile e altri contenuti ritenuti impropri. A parole sembrerebbe facile. Non lo è se parliamo di servizi in costante crescita con miliardi di utenti.

Come controllare i milioni di post che vengono segnalati ogni giorno? Negli ultimi anni Facebook e altri social network hanno dovuto aumentare le risorse dedicate alla moderazione. Dopo le elezioni del 2016, è cresciuta la pressione sulla compagnia da parte dei media e dell'opinione pubblica. Il numero di moderatori non era più sufficiente a gestire tutte le segnalazioni e l'AI, al momento, non è in grado di svolgere il lavoro di un essere umano. La piattaforma si è dovuta affidare quindi a compagnie esterne, come Accenture, Cognizant e Genpact.

“Quando i moderatori lavorano da casa, puoi implementare controlli molto stretti sui loro computer per monitorare il loro accesso ai dati degli utenti. Quando lavorano per compagnie esterne, c’è un rischio molto maggiore che i dati personali degli utenti vengano resi pubblici”, spiega Casey Newton.

Dopo lo scandalo di Cambridge Analytica, l’uso illecito di dati da parte di compagnie esterne è diventata una delle preoccupazioni più grandi per Facebook. Ecco perché la moderazione di siti come Facebook e YouTube viene svolta in “stanze sicure”, dove i lavoratori vengono controllati in entrata e uscita e non sono autorizzati a portare con sé dispositivi personali, come cellulari, tablet o computer.

Permettere a migliaia di moderatori di lavorare da casa potrebbe essere una catastrofe per la privacy degli utenti e, di conseguenza, per l’immagine delle compagnie tecnologiche.