L’Europa presenta le nuove regole per il digitale

14 min letturaLe nuove norme per il digitale

Il progetto del presidente della Commissione europea Ursula von der Leyen è estremamente ambizioso e mira a portare, come la Roma dei Cesari, l’Europa al centro del mondo. Complice probabilmente anche la consapevolezza di essere tecnologicamente indietro rispetto a Cina e Usa, l’Unione Europea con le nuove regole in definizione si prepara a regolamentare l'ecosistema digitale con un pugno duro, in particolare contro gli stranieri che entrano nel mercato europeo. Al centro del processo decisionale la zar antitrust Margrethe Vestager e il commissario per il mercato interno Thierry Breton.

Il cambio di marcia si è manifestato con una varietà di iniziative legislative. Il 15 dicembre sono state presentate le proposte in materia di regolamentazione dei servizi digitali (Digital Services Act, DSA) e del mercato digitale (Digital Markets Act, DMA), che si aggiungono alle regole per la gestione dei dati (Data Governance Act, DGA). Nulla è ancora deciso, il complesso degli atti legislativi dovrà ovviamente passare numerose fasi per una finalizzazione, ma le proposte sono estremamente indicative della direzione presa dall’Europa.

La prima evidenza, però, riguarda il processo formativo, che già normalmente non è del tutto trasparente, in quanto spesso si realizza tramite meeting con gli stakeholders, ma nel caso specifico, causa la pandemia, si è svolto in riunione virtuali via chat. Secondo il Corporate Europe Observatory, si sono svolte quasi 160 riunioni di lobby, e il maggior numero di incontri è stato ottenuto da Google, Microsoft e Facebook. Le grandi aziende Tech si sono presentate, stavolta, divise, in quanto i nuovi piani antitrust preparati dall'Europa hanno alimentato contrasti tra loro. L’iniziale preoccupazione delle aziende Tech per le regole del DSA, quindi, si è focalizzata sul DMA, una rivisitazione delle regole antitrust e degli obblighi per i gatekeeper tecnologici. Il DMA è diventato il centro dello scontro lobbistico, con le piattaforme divise e i potenti gruppi editoriali compatti a scagliarsi contro di esse. Il processo di formazione delle norme svolto prevalentemente su Zoom, ha reso molto difficile per le associazioni dei diritti civili inserirsi nelle discussioni rilevanti, tra i capi delle grandi aziende e dei gruppi editoriali.

La normativa proposta è complessa, ma è significativo che a maggio 2020 l'europarlamentare Tiemo Wölken abbia dichiarato che occorre garantire il rispetto dei diritti fondamentali dei cittadini anche online così come offline, e quindi che i contenuti non debbano essere eliminati arbitrariamente, soprattutto non a discrezione delle imprese private.

Le idee sul tavolo toccano numerosi argomenti:

- Un regolamento sui diritti contrattuali in riferimento alla gestione dei contenuti online, che fissa i principi per la moderazione degli stessi (un sistema di notice and take down)

- L’istituzione di un’Agenzia europea per la gestione dei contenuti e per gli algoritmi di moderazione utilizzati dalle piattaforme

- Un meccanismo di risoluzione delle controversie indipendente e improntato al pieno rispetto dei diritti fondamentali dei cittadini

- La trasparenza sulla gestione dei contenuti da parte delle imprese private, con relazioni da inviare all’Agenzia e pubblicazione di report delle rimozioni in modo che siano accessibili al pubblico

Digital Services Act (DSA)

Il primo regolamento, già atteso, è il DSA che mira a disciplinare come le piattaforme (es. Facebook, Google) influenzano gli utenti e regolano il dibattito sui loro servizi, in particolare verificando l’impatto sui diritti dei cittadini. La proposta legislativa affronta anche altri temi.

In proposito la Commissione europea il 2 giugno 2020 ha lanciato una consultazione, che poi è servita anche per le altre regolamentazioni, incentrata su 6 argomenti principali:

- Mercato unico

- Sicurezza degli utenti in rete

- Regime di responsabilità degli operatori online

- La condizione di gatekeeper delle piattaforme del web

- Pubblicità online

- Condizioni dei lavoratori delle piattaforme

I contributi delle aziende non si sono fatti attendere. Da Facebook che invitava alla prudenza nell’assumere nuove regole, a Google che suggeriva di adattare gli strumenti oggi già presenti, piuttosto che creare un nuovo framework normativo, ad Apple che al solito si presentava come differente rispetto alle altre aziende che sfruttano i dati degli utenti.

Anche le pressioni dei grandi gruppi editoriali sono state pesanti. Le richieste si possono evincere da una serie di email. Gran parte degli editori ha chiesto che le modifiche al regime di responsabilità per i contenuti siano applicate solo alle piattaforme del web, escludendo gli editori. Inoltre hanno chiesto che le piattaforme siano ritenute responsabili per i contenuti di terzi in particolare se l’utente è “anonimo” oppure non indica un indirizzo identificabile (con ciò eludendo le forze dell’ordine, secondo gli editori). Infine hanno chiesto di non applicare nessuna restrizione alla pubblicità online (restrizioni, divieti, requisiti, etichettature) in quanto avrebbe, sempre secondo loro, un impatto diretto sugli introiti della stampa in Europa.

L'industria televisiva e cinematografica ha chiesto espressamente misure antipirateria, e di non espandere le esenzioni per le piattaforme in materia di responsabilità per i contenuti, secondo loro già eccessive. La MPA, che rappresenta le principali aziende cinematografiche, ha chiesto uno specifico obbligo per i fornitori di servizi di non fare affari con partner anonimi.

La posizione del Parlamento europeo è delineata dai rapporti delle Commissioni (IMCO, JURI, LIBE) votati il 20 ottobre 2020. Pur non essendo vincolati, i rapporti evidenziano un ampio accordo sul fatto che il DSA dovrebbe vietare qualsiasi obbligo generale di monitoraggio, cioè evitare di imporre legalmente l’uso di filtri di caricamento. Inoltre si porta avanti l’idea che le piattaforme debbano essere ritenute responsabili di contenuti illegali solo quando ne siano effettivamente a conoscenza. Molti membri del Parlamento europeo hanno compreso che la diffusione di contenuti illegali, e le campagne di disinformazione e molestie online, nonché la crescente polarizzazione della società non possono essere fermate semplicemente costringendo le piattaforme del web a regolare in qualche modo tali contenuti. Dai rapporti del Parlamento non si evince, però, una vera e propria richiesta di interoperabilità, si chiede soltanto alla Commissione di esplorare le opzioni per facilitare l'interoperabilità dei servizi.

Differente è stato l’approccio di DG HOME (responsabile della Commissione europea dei temi dell’immigrazione, tratta di esseri umani, criminalità informatica e terrorismo), più improntato a una idea che internet sia un luogo illegale utilizzato per furti di identità, ransomware, pornografia infantile, istigazione al terrorismo, organizzazione della criminalità grazie alla crittografia. In tal senso DG HOME ha proposto l’obbligo di misure proattive (filtri di upload che purtroppo notoriamente sono soggetti ad abusi) per prevenire l’abuso dei servizi, così realizzando un vero e proprio monitoraggio generalizzato (che in teoria è vietato dalle norme europee). Inoltre ritiene essenziale che le aziende Tech introducano meccanismi di cancellazione degli account che pubblicano contenuti illegali o dannosi (come fake news), idea in parte ripresa dalle proposte legislative. In questo modo le imprese private diverrebbero gli sceriffi della “verità online”.

Gestione dei contenuti online

Il DSA, così come presentato in bozza, si occupa di regolamentare le piattaforme che consentono l’espressione, la creazione e la trasmissione o l’accesso ad informazioni o creazioni culturali, e il dialogo tra gli utenti, cioè quelle che contribuiscono a formare la “sfera pubblica”. Tali piattaforme contribuiscono ad assicurare l’esercizio dei diritti fondamentali (libertà di espressione, libertà di associazione, ecc…) e supportano la realizzazione di valori sociali (informazione per i cittadini, educazione, dialogo democratico), anche se nel contempo consentono la diffusione di contenuti dannosi. In tal senso appare ormai evidente che la moderazione dei contenuti è essenziale, non bastano le sole leggi e l’intervento della magistratura o di autorità statali. Non si tratta soltanto della enorme quantità dei contenuti immessi ogni secondo online, ma anche del fatto che sono presenti online diversi tipi di ambienti di discussione con caratteristiche proprie, da cui la necessità della moderazione dei contenuti da parte dei fornitori degli spazi online, sia nel caso in cui la moderazione serve piattaforme mosse da interessi economici sia nel caso in cui siano no-profit (es. Wikipedia).

Con riferimento alle principali piattaforme, e in considerazione della enorme quantità di contenuti immessa sui loro server, non si può non considerare la moderazione attuata tramite sistemi di filtraggio dei contenuti. È evidente, come riconosciuto anche da uno studio della Commissione JURI (The impact of algorithms for online content filtering or moderation), che gli algoritmi sono tutt’altro che perfetti, e possono portare ad errori (falsi positivi o negativi), per cui devono essere considerati quali meri componenti di un sistema di moderazione più ampio, composto da umani che integrano la tecnologia revisionando il sistema, e correggendo gli errori del sistema.

La diatriba tra quelli che sostengono posizioni di must-remove e quelli che preferiscono posizioni di must-carry è ormai risalente nel tempo. I primi ritengono che le piattaforme debbano rimuovere tutto ciò che è illegale (salvo che per molti contenuti non c’è concordanza tra le legislazioni nazionali su cosa è illegale e cosa no) o addirittura inopportuno (e qui si entra nel campo del puramente soggettivo), i secondi invece, per evitare che si scada in discriminazioni (chi ha maggior potere economico o politico può creare maggiori problemi alle piattaforme per cui le piattaforme tenderebbero a favorirli rispetto agli utenti normali), ritengono che le piattaforme debbano limitarsi a far fluire i contenuti tranne ciò che è espressamente vietato dalle leggi. Regole di questo tipo sono mutuate dalla normative relative alle televisioni, ma lì entra in gioco il problema della scarsità di spettro che non esiste online, per cui il paragone è impossibile.

Il DSA fa le sue scelte, e le nuove regole si applicano ai servizi digitali indirizzati agli utenti europei di uno o più Stati con un significativo numero di utenti. La proposta consente di adeguare al mutato quadro tecnologico la regolamentazione già presente, senza però snaturarla, quindi mantenendo le esenzioni per le piattaforme del web. Il problema è che la rete internet è stata lasciata alla regolamentazione dei privati (come accaduto per la televisione), e l’incentivo economico è stata la base per modellare l’ecosistema digitale, con ciò favorendo anche la diffusione di contenuti di disinformazione e scandalistici (perché si diffondono meglio e consentono di vendere più pubblicità). Il DSA sostanzialmente delega alle aziende la regolamentazione dei contenuti online, imponendo loro un “dovere di diligenza”. Le piattaforme che raggiungono almeno 45 milioni di utenti nell’Unione europea (aziende di importanza “sistemica”) avranno obblighi aggiuntivi e in particolare dovranno limitare la diffusione dei contenuti illegali (hate speech, prodotti contraffatti, ecc…) attraverso i loro servizi. È prevista anche l’introduzione di regole sulla falsariga della clausola del Buon Samaritano presente nella normativa Usa, che incentiverebbe effettivamente le aziende a moderare i contenuti online.

Leggi anche >> Digital Service Act: l’Europa prepara le nuove regole per le piattaforme online (in particolare sul level playing field)

Gli articoli 14 e seguenti stabiliscono il meccanismo di Notice and Action. Le piattaforme devono mettere a disposizione degli utenti degli strumenti semplici per notificare la presenza di quelli che il notificante ritiene siano contenuti illegali (i contenuti devono essere espressamente identificati per URL). La piattaforma poi deciderà se rimuovere o meno, predisponendo un meccanismo di impugnazione diretto ad un organismo terzo ed imparziale (non un tribunale), oltre che certificato. Le decisioni sono pubblicate (senza dati personali) in un apposito database gestito dalla Commissione europea. Se l’organismo decide a favore dell’utente, sarà la piattaforma a rimborsare le spese per rivolgersi all’organismo di risoluzione della disputa.

Dalla procedura emerge che è la piattaforma a stabilire cosa è illegale o meno, chiunque può inviare una notifica ritenendo un contenuto illegale e tale notifica comporta la “conoscenza effettiva” da parte della piattaforma. Ciò significa che da quel momento la piattaforma è responsabile del contenuto notificato. La piattaforma può, inoltre, rimuovere i contenuti anche con sistemi automatizzati, senza necessariamente avvertire l’utente che ha caricato il contenuto. La procedura, quindi, spinge la piattaforma a rimuovere ciò che è incerto per evitare di doverne rispondere, così portando a possibili fenomeni di overblocking.

Il DSA, inoltre, legittima i cosiddetti trusted flaggers, cioè dei soggetti ai quali sono posti a disposizione strumenti per notifiche cumulative e veloci, sostanzialmente come già accade, ad esempio, su YouTube, per le aziende titolari dei diritti di copyright che hanno una canale privilegiato.

Significativo è che il DSA vieti il “monitoraggio generale”, statuizione importante perché su questo divieto si è discusso molto, anche con riferimento alla direttiva copyright.

Le autorità nazionali e della UE, infine, avranno il potere di chiedere informazioni alle piattaforme ed effettuare verifiche in loco. In caso di non conformità possono scattare multe fino al 6% del fatturato annuo. Gli operatori stranieri dovranno nominare un rappresentante nel territorio dell’Unione europea.

Pubblicità online

Per quanto riguarda la regolamentazione della pubblicità microtargeting, le nuove proposte normative evidenziano l’impatto che tali pratiche hanno sui cittadini. Addirittura la Commissione JURI aveva proposto di prendere in considerazione l’eliminazione graduale della pubblicità online microtargeting. Qui bisogna ricordare che tale tipo di pubblicità in realtà è già soggetta a regolamentazione del GDPR, e richiede il consenso esplicito da parte degli utenti (non è sufficiente come base giuridica il legittimo interesse del titolare).

La direzione intrapresa è di imporre alle piattaforme di consentire agli utenti di non essere soggetti a tracciamento pervasivo quando utilizzano i servizi digitali. Le piattaforme devono dare agli utenti la possibilità di scegliere se vedere o meno pubblicità mirata. La normativa in preparazione impone obblighi di trasparenza, in particolare le piattaforme dovranno fornire dettagli sugli inserzionisti e limitare gli annunci se violano le regole sui contenuti. Dovranno inoltre pubblicare dettagli su come i loro algoritmi indirizzano i contenuti agli utenti.

Gli obblighi di trasparenza sono un passo importante, ma non appaiono sufficienti a contrastare l’incentivo economico alla diffusione di contenuti dannosi e di disinformazione. Il profitto che si riesce a ricavare dai contenuti virali è molto elevato.

Digital Markets Act (DMA)

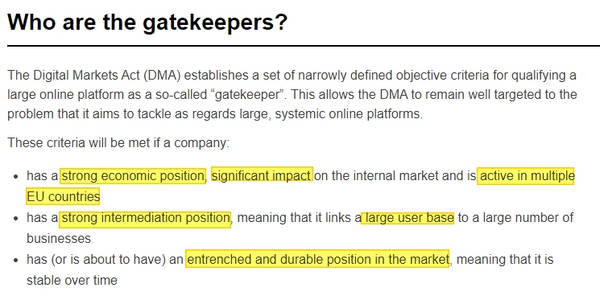

Il problema principale di internet oggi è la presenza di pochi operatori che controllano il mercato (gatekeeper), come ad esempio Amazon che controlla chi vende attraverso la sua piattaforma, oppure Apple e Google che con i loro App Store controllano gli sviluppatori di App. Questa situazione è probabilmente la conseguenza del fatto che la regolamentazione è stata lasciata per anni alle stesse aziende, cosa che ha comportato l’emergere di attori dominanti, così come accaduto per la televisione. Trattandosi di problemi strutturali si è compreso che le sanzioni, anche se elevate, non ottengono il risultato sperato. Lo scopo della proposta legislativa è di regolamentare la concorrenza nel mercato digitale ex ante, rompendo i grandi monopoli tecnologici, ed è un’iniziativa del Commissario Vestager. È piuttosto palese che al momento esiste uno squilibrio importante tra grandi aziende e il resto degli attori nel mercato digitale, laddove tale squilibrio porta a numerose ricadute negative. Il DMA si propone di risolvere tale squilibrio con una serie di strumenti.

Per stabilire se un’azienda è soggetta al DMA si utilizzano i seguenti criteri:

- Il fatturato annuo nel SEE (Spazio economico europeo) che deve essere pari o superiore a 6,5 miliardi di euro negli ultimi 3 esercizi finanziari (Facebook, ad esempio, nel 2019 ha avuto un fatturato di 70 miliardi), oppure la capitalizzazione di mercato media se ammonta ad almeno 65 miliardi di euro nell’ultimo esercizio finanziario.

- Un servizio di piattaforme con oltre 45 milioni di utenti finali attivi mensilmente stabiliti nell’UE e più di 10mila utenti aziendali attivi all’anno.

- I due criteri devono essere soddisfatti insieme per gli ultimi tre esercizi finanziari.

Il DMA divide le attività dei gatekeeper in servizi principali (es. la vendita di App in un App Store) e servizi accessori (es. l’elaborazione di pagamenti, la pubblicità), imponendo oneri maggiori per i secondi. Ad esempio, vieta alle piattaforme di imporre ai propri clienti l’utilizzo del proprio processore di pagamenti. Vi sono una serie di obblighi e divieti che impattano notevolmente sui servizi delle grandi aziende del web. Ad esempio, il DMA vieta ai gatekeeper di combinare i dati relativi ai servizi principali con i dati degli altri servizi offerti dal gatekeeper (art. 5.a), a meno di non ottenere lo specifico consenso dell’utente (ai sensi del GDPR). Cioè Facebook e Google, ad esempio, non potranno combinare i dati dei loro utenti con quelli dei loro clienti aziendali e dei data broker. Ancora, l’accesso a un servizio Google (es. Gmail) non consentirà di accedere automaticamente ad altro servizio Google (es. YouTube).

L’art. 5.b vieta alle piattaforme di imporre regole sui prezzi e i termini stabiliti dai loro clienti aziendali, quindi non si potrà vietare ad una azienda di scontare dei servizi se venduti direttamente anziché tramite l’App Store. L’art. 5.e vieta ai gatekeeper di imporre l’accesso ai propri servizi esclusivamente tramite i propri servizi di identità. Il 5.f vieta di imporre l’iscrizione ai propri servizi ausiliari. L’art. 6.c impone ai gatekeeper di consentire App Store concorrenti, fermo restando necessità di sicurezza.

L’art. 6.f impone misure di interoperabilità dei servizi, cioè i gatekeeper devono consentire ad altri fornitori di servizi ausiliari di collegarsi ai loro servizi principali alle stesse condizioni che godono i servizi ausiliari del gatekeeper. Non c’è, però obbligo di interoperabilità per i servizi principali.

Si tratta di regole stringenti e dettagliate che impattano notevolmente sui gatekeeper dell’ecosistema digitale, e ciò ha portato alle aziende tecnologiche, che hanno modelli di business differenti, a spaccarsi nell’attività di lobbying contro il DMA. Ad esempio Facebook ha accusato Apple di pratiche commerciali sleali per il modo in cui viene gestito l’App Store. Apple controlla un intero ecosistema e, secondo il social in blu, utilizza questo controllo per danneggiare sviluppatori e consumatori. Secondo Facebook dovrebbe essere impedito a Apple di favorire i propri servizi rispetto a quelli offerti da altre aziende.

Le sanzioni possono arrivare fino al 10% del fatturato annuo.

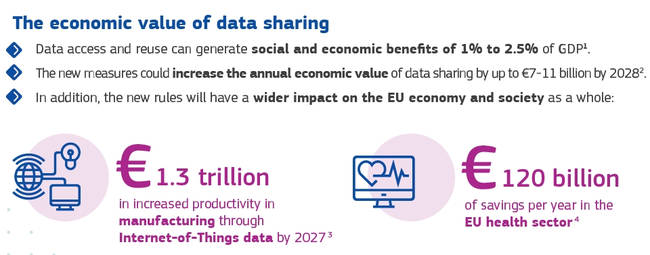

Data Governance Act (DGA)

La proposta legislativa, presentata a novembre, mira a promuovere la disponibilità dei dati rafforzando i meccanismi di condivisione dei dati in Europa, così aumentando la fiducia negli intermediari. L’obiettivo è consentire alle aziende di beneficiare del valore economico della condivisione dei dati. La proposta include norme per consentire l’utilizzo di dati a trattamento speciale (sensibili) da parte del settore pubblico, il riutilizzo tramite degli intermediari, e la condivisione dei dati tra imprese. In tale prospettiva il DGA appare più incentrato sul favorire l’economia e quindi le aziende, piuttosto che tutelare i cittadini, col rischio di minare le protezioni previste dal GDPR, presentandosi come lex specialis rispetto a quest’ultimo.

Il DGA, quindi, non appare ben bilanciato, aprendo la strada a condivisioni dei dati in numero indefinito, senza uno scopo chiaro. Inoltre non prevede nemmeno il concetto di Open Data. La “monetizzazione” del diritto alla protezione dei dati personali sembra fare un passo in avanti, così aprendo la strada a nuovi modelli di business, ma di contro porterà sicuramente a ricadute negative sugli utenti, in particolare perché quando si “monetizza” un diritto è evidente che i più abbienti riescono ad ottenere una tutela maggiore.

Conclusioni

Le norme sopra commentate sono le proposte della Commissione europea, alle quali nei prossimi anni si affiancheranno analoghe proposte del Parlamento e del Consiglio dell’Unione europea. La finalizzazione delle norme non si avrà prima di due anni.

Il processo legislativo sarà sicuramente non facile, e sarà caratterizzato da un’intesa attività di lobbying non solo da parte delle grandi aziende Tech, ma anche dei gruppi editoriali e delle associazioni per i diritti civili.

Il DMA, da un lato, appare più semplice da finalizzare, in quanto ha provocato una profonda spaccatura tra le aziende Tech, ma dall’altro deve presentarsi come un framework generale per non incappare in potenziali azioni legali. Se il DMA si presenta come strumento di concorrenza, e quindi una regolamentazione per i soli gatekeeper, potrebbe essere impugnato dalle aziende Tech come strumento teso specificamente ad ostacolarle.

Ovviamente tali normative non mancheranno di aprire un fronte anche verso gli Usa, che già hanno sostenuto trattarsi di regole protezionistiche e discriminatorie nei confronti delle aziende Usa.

Nelle norme proposte mancano, purtroppo, varie cose. Se è positivo che le esenzioni per gli intermediari non sono state eliminate, cosa che sarebbe ricaduta sulla libertà di espressione degli utenti, i disincentivi alle richieste di rimozione abusive sembrano limitati (è prevista solo una sospensione dell’account).

Inoltre non c’è alcun obbligo di interoperabilità per i servizi principali, cosa che potrebbe garantire una limitazione al potere monopolistico della grandi aziende Tech. Se non si concede agli utenti il diritto di dialogare con utenti su altre piattaforme senza dover necessariamente aprire un nuovo account, rimarranno i walled garden, i giardini recintati che favoriscono i monopoli (come Apple, Facebook, ecc…) a scapito degli utenti.

Articolo correlati:

Digital Service Act: l’Europa prepara le nuove regole per le piattaforme online

Per una regolamentazione delle piattaforme digitali